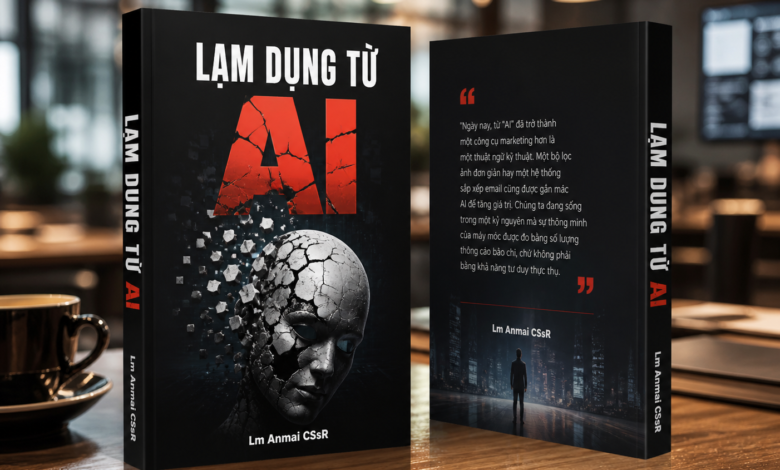

LẠM DỤNG TỪ “AI”

Lạm dụng từ “AI”: “Ngày nay, từ ‘AI’ đã trở thành một công cụ marketing hơn là một thuật ngữ kỹ thuật. Một bộ lọc ảnh đơn giản hay một hệ thống sắp xếp email cũng được gắn mác AI để tăng giá trị. Chúng ta đang sống trong một kỷ nguyên mà sự thông minh của máy móc được đo bằng số lượng thông cáo báo chí, chứ không phải bằng khả năng tư duy thực thụ.”

Phần 1: Giải mã ảo tưởng – Khi “Trí tuệ” chỉ là những con số

Chương 1: AI không “biết” gì cả – Bản chất của những con số

ĐỂ HIỂU ĐÚNG VỀ AI: KHI “TRÍ TUỆ” CHỈ LÀ NHỮNG PHÉP TÍNH ĐƯỢC MỞ RỘNG ĐẾN TẬN CÙNG

Để hiểu đúng về trí tuệ nhân tạo, trước hết chúng ta phải dám tháo bỏ một lớp áo tưởng tượng đã phủ lên nó suốt nhiều thập kỷ: hình ảnh về những “bộ não điện tử” biết suy nghĩ, biết cảm nhận, biết yêu ghét như con người trong các bộ phim viễn tưởng. Những hình ảnh đó hấp dẫn, kích thích trí tưởng tượng, nhưng đồng thời cũng làm sai lệch nhận thức của chúng ta về bản chất thật sự của AI. Bởi vì, thực tế khô khốc hơn nhiều: AI không sở hữu trí tuệ, nó sở hữu các phép tính.

Nói cách khác, AI không “hiểu” thế giới theo nghĩa con người hiểu. Nó không có ý thức, không có trải nghiệm sống, không có ký ức mang chiều sâu cảm xúc. Nó không biết đau, không biết vui, không có nỗi sợ hay hy vọng. Tất cả những gì AI làm, dù có vẻ tinh vi đến đâu, đều dựa trên việc xử lý dữ liệu bằng những mô hình toán học cực kỳ phức tạp. Nó nhận đầu vào, tính toán theo các quy luật đã được huấn luyện, và tạo ra đầu ra có xác suất cao là “phù hợp” với những gì nó đã học.

Điều khiến AI trở nên “giống người” không nằm ở bản chất của nó, mà nằm ở quy mô và độ tinh vi của các phép tính. Khi dữ liệu đủ lớn, mô hình đủ sâu, và khả năng tính toán đủ mạnh, kết quả mà AI tạo ra có thể bắt chước rất sát cách con người sử dụng ngôn ngữ, giải quyết vấn đề, hay thậm chí sáng tạo. Nhưng bắt chước không phải là hiểu. Một hệ thống có thể viết một bài văn cảm động mà không hề cảm thấy điều gì. Nó có thể trả lời những câu hỏi triết học mà không hề “suy tư”. Nó có thể trò chuyện về nỗi buồn mà không hề biết buồn là gì.

Chính ở điểm này, sự tỉnh táo của con người trở nên cực kỳ quan trọng. Nếu chúng ta gán cho AI những phẩm chất mà nó không có, chúng ta sẽ bắt đầu tin vào những điều không đúng: rằng AI có thể thay thế hoàn toàn con người, rằng AI có thể đưa ra những quyết định đạo đức, rằng AI có thể “hiểu” con người sâu sắc hơn chính con người. Nhưng nếu nhìn đúng, chúng ta sẽ thấy: AI chỉ là một công cụ cực kỳ mạnh mẽ—một cỗ máy xử lý thông tin, không hơn.

Sự khác biệt giữa con người và AI không nằm ở tốc độ xử lý hay dung lượng lưu trữ, mà nằm ở chiều sâu của ý thức. Con người không chỉ tính toán; con người trải nghiệm. Con người không chỉ phản ứng; con người suy tư về chính phản ứng của mình. Con người có khả năng đặt câu hỏi về ý nghĩa, về giá trị, về đúng sai—những điều mà AI không thể tự mình làm được. Một thuật toán có thể tối ưu hóa một quyết định dựa trên dữ liệu, nhưng nó không thể tự hỏi: “Quyết định này có nhân bản không? Có công bằng không? Có đáng để làm không?”

Chúng ta cũng cần nhận ra rằng, cái gọi là “trí tuệ” của AI thực chất là trí tuệ được vay mượn từ con người. Dữ liệu mà AI học đến từ đâu? Từ sách vở do con người viết, từ hình ảnh do con người chụp, từ lời nói, suy nghĩ, sáng tạo của hàng triệu, hàng tỷ con người. AI không tự sinh ra tri thức; nó tái tổ chức tri thức đã có. Nó giống như một tấm gương khổng lồ, phản chiếu lại những gì nhân loại đã tạo ra—có thể nhanh hơn, rộng hơn, nhưng không sâu hơn theo nghĩa hiện sinh.

Tuy nhiên, nói như vậy không có nghĩa là AI tầm thường. Ngược lại, chính vì nó là một hệ thống tính toán cực kỳ hiệu quả, AI có thể làm những điều mà con người không thể làm trong cùng một khoảng thời gian. Nó có thể phân tích hàng triệu dữ liệu trong vài giây, phát hiện những mẫu hình mà con người khó nhận ra, hỗ trợ trong y học, giáo dục, khoa học, và vô số lĩnh vực khác. Vấn đề không phải là đánh giá thấp AI, mà là đặt nó đúng vị trí của nó.

Một con dao có thể cứu người trong tay bác sĩ, nhưng cũng có thể gây hại trong tay kẻ xấu. AI cũng vậy. Nó không có đạo đức nội tại; đạo đức nằm ở người sử dụng. Nếu con người sử dụng AI để thao túng thông tin, lan truyền sai sự thật, hay thay thế sự suy nghĩ cá nhân bằng sự phụ thuộc mù quáng, thì hậu quả sẽ rất lớn. Nhưng nếu con người sử dụng AI như một công cụ hỗ trợ—để mở rộng khả năng, để tiết kiệm thời gian, để đào sâu hiểu biết—thì nó có thể trở thành một bước tiến quan trọng của nhân loại.

Có một nguy cơ tinh vi hơn: khi AI ngày càng giỏi, con người có thể trở nên lười suy nghĩ. Khi mọi câu trả lời đều có sẵn, người ta có thể ngừng đặt câu hỏi. Khi mọi phân tích đều được thực hiện, người ta có thể ngừng học cách phân tích. Và khi đó, điều mất đi không phải là thông tin, mà là năng lực nội tại của con người. AI có thể làm nhanh hơn, nhưng nếu con người không còn biết suy nghĩ, thì chính con người đang tự làm mình nghèo đi.

Vì thế, hiểu đúng về AI không chỉ là hiểu về công nghệ, mà còn là hiểu về chính mình. Khi ta nói “AI không có trí tuệ, nó chỉ có phép tính”, ta không hạ thấp AI, mà đang bảo vệ một điều sâu sắc hơn: phẩm giá của trí tuệ con người. Trí tuệ không chỉ là khả năng đưa ra câu trả lời đúng, mà còn là khả năng đặt câu hỏi đúng, khả năng phân định điều thiện điều ác, khả năng sống có ý nghĩa.

AI có thể giúp ta đi nhanh hơn, nhưng không thể quyết định ta nên đi đâu. AI có thể giúp ta thấy nhiều hơn, nhưng không thể cho ta đôi mắt để nhận ra điều gì là đáng nhìn. AI có thể giúp ta nói hay hơn, nhưng không thể cho ta một trái tim để nói điều chân thật.

Cuối cùng, có lẽ điều quan trọng nhất không phải là AI sẽ trở nên mạnh đến đâu, mà là con người sẽ giữ được điều gì khi AI ngày càng mạnh. Nếu chúng ta biết dùng AI để phục vụ con người, thì đó là tiến bộ. Nhưng nếu chúng ta để con người dần trở thành phụ thuộc vào AI, thì đó không còn là tiến bộ nữa, mà là một sự đánh mất âm thầm.

Hiểu đúng về AI là hiểu rằng: nó không phải là một “trí tuệ khác” cạnh tranh với con người, mà là một công cụ phản chiếu và khuếch đại những gì con người đã có. Và vì thế, câu hỏi không còn là “AI có thể làm gì?”, mà là “con người muốn trở thành ai khi có AI trong tay mình?”

1.1. CƠN ÁC MỘNG CỦA SỰ HIỂU LẦM: “BIẾT” VS “TÍNH”

Khi bạn cúi xuống hỏi một đứa trẻ: “Con mèo kêu thế nào?”, điều đang diễn ra không chỉ là một câu hỏi – đó là một cuộc chạm nhẹ vào thế giới sống động bên trong tâm trí của nó. Đứa trẻ không “tính toán” câu trả lời. Nó nhớ lại hình ảnh một con mèo đã từng thấy – có thể là con mèo nằm cuộn tròn ngoài sân, con mèo chạy ngang qua đường, hay thậm chí là một con mèo trong truyện tranh. Ký ức ấy không đứng một mình; nó đi kèm với âm thanh, cảm xúc, bối cảnh. Và rồi, từ một tổng thể sống động ấy, đứa trẻ bật ra: “Meo meo.”

Âm thanh đó không chỉ là một từ. Nó là kết quả của một quá trình hiểu – hiểu rằng “con mèo” là một sinh vật cụ thể, rằng sinh vật ấy phát ra âm thanh đặc trưng, rằng âm thanh đó có thể được tái hiện lại bằng giọng nói của mình. Nói cách khác, đứa trẻ không chỉ trả lời; nó đang tái hiện một phần thế giới.

Nhưng khi bạn hỏi một mô hình ngôn ngữ lớn (LLM) cùng câu hỏi đó, toàn bộ tiến trình bên trong lại hoàn toàn khác – và cũng hoàn toàn “khô” hơn theo nghĩa con người. Không có con mèo nào xuất hiện trong “tâm trí” của AI. Không có ký ức, không có hình ảnh, không có trải nghiệm. Không có một buổi chiều nào, không có ánh nắng nào, không có cảm giác vuốt ve bộ lông mềm.

Thay vào đó, điều xảy ra là một phép toán.

Trong không gian biểu diễn gọi là “vector space” – một không gian toán học với hàng tỷ tham số – cụm từ “Con mèo kêu…” được biến đổi thành một chuỗi các con số. Những con số này không “nghĩa” theo cách con người hiểu, mà là các tọa độ biểu thị mối liên hệ thống kê giữa các từ dựa trên dữ liệu đã học. Từ đó, mô hình sẽ tính toán xác suất: trong vô số văn bản mà nó từng được huấn luyện, sau cụm từ “Con mèo kêu…”, từ nào thường xuất hiện nhất?

Kết quả thường là “meo”.

Không phải vì AI “biết” mèo kêu “meo”, mà vì trong dữ liệu quá khứ, chuỗi “Con mèo kêu meo” có xác suất cao hơn các chuỗi khác.

Ở đây, ta chạm đến một sự khác biệt nền tảng:

Con người: Hiểu khái niệm → Truyền đạt.

Con người xây dựng khái niệm từ trải nghiệm. Một “con mèo” không chỉ là một từ, mà là một thực thể đa chiều: hình dạng, âm thanh, hành vi, cảm xúc liên quan. Khi nói, con người không chỉ chọn từ – họ biểu đạt một phần của thế giới mà họ đã sống.

AI: Phân tích dữ liệu quá khứ → Dự đoán thống kê.

AI không có thế giới để sống. Nó chỉ có dữ liệu để phân tích. Nó không “biết” mà chỉ “ước đoán”. Mỗi câu trả lời là một phép dự đoán có điều kiện: dựa trên những gì đã thấy, điều gì có khả năng đúng nhất tiếp theo?

Sự khác biệt này dẫn đến một hiểu lầm rất phổ biến: khi AI trả lời trôi chảy, mạch lạc, thậm chí có vẻ “thông minh”, con người dễ gán cho nó một dạng hiểu biết tương tự mình. Nhưng đó là một ảo giác ngôn ngữ.

Ngôn ngữ, vốn là phương tiện biểu đạt của con người, lại trở thành lớp vỏ che giấu bản chất của AI. Khi một mô hình nói: “Con mèo kêu meo”, nó không đang nói về một con mèo. Nó đang hoàn thành một chuỗi xác suất.

Điều này không làm AI trở nên “kém giá trị”. Ngược lại, chính cơ chế thống kê này lại tạo nên sức mạnh đáng kinh ngạc của nó. Nhờ khả năng học từ lượng dữ liệu khổng lồ, AI có thể:

Viết văn bản mạch lạc

Dịch ngôn ngữ

Tóm tắt thông tin

Hỗ trợ phân tích dữ liệu

Nhưng tất cả những điều đó vẫn nằm trong một giới hạn rõ ràng: AI không có trải nghiệm, không có ý thức, không có trực giác sống.

Nó không biết thế nào là một buổi chiều mưa khi con mèo nằm ngủ bên cửa sổ.

Nó không biết cảm giác vuốt ve một sinh vật sống.

Nó không biết sự gắn bó giữa con người và thú cưng.

Nó chỉ biết rằng những câu như vậy thường đi chung với nhau.

Và chính ở đây, trách nhiệm của con người trở nên quan trọng hơn bao giờ hết. Nếu ta nhầm lẫn giữa “dự đoán đúng” và “hiểu thật”, ta có thể trao cho AI những vai trò mà nó không thể đảm nhận một cách trọn vẹn – đặc biệt là những quyết định liên quan đến đạo đức, cảm xúc, hay ý nghĩa cuộc sống.

AI có thể hỗ trợ suy nghĩ, nhưng không thể thay thế suy nghĩ.

AI có thể cung cấp thông tin, nhưng không thể sống thay trải nghiệm.

AI có thể mô phỏng sự hiểu, nhưng không thể thực sự hiểu.

Vì thế, khi sử dụng AI, điều quan trọng không phải là sợ nó “quá thông minh”, mà là hiểu rõ nó “thực sự là gì”.

Một công cụ.

Một công cụ cực kỳ mạnh mẽ, nhưng vẫn chỉ là công cụ.

Và có lẽ, trong một thế giới ngày càng đầy những câu trả lời được tạo ra trong tích tắc, điều quý giá nhất mà con người cần giữ lại không phải là khả năng trả lời nhanh – mà là khả năng hiểu chậm.

Hiểu bằng trải nghiệm.

Hiểu bằng suy tư.

Hiểu bằng chính cuộc đời mình.

1.2. CƠ CHẾ CỦA “CÁI GƯƠNG VẠN HOA” DỮ LIỆU

Hãy thử cầm một chiếc gương vạn hoa lên và xoay nhẹ. Những mảnh thủy tinh nhỏ bé, vốn không có ý nghĩa gì khi đứng riêng lẻ, bỗng ghép lại thành những hoa văn rực rỡ, đối xứng, đầy mê hoặc. Nhưng điều quan trọng là: chiếc gương ấy không tạo ra bất kỳ mảnh thủy tinh nào. Nó chỉ sắp xếp lại những gì đã có.

AI – đặc biệt là các mô hình ngôn ngữ lớn hay mô hình tạo ảnh – vận hành theo một nguyên lý tương tự, nhưng ở quy mô mà trí óc con người khó có thể hình dung. Nó không “sáng tạo” theo nghĩa con người hiểu. Nó không có ký ức theo kiểu trải nghiệm sống, không có cảm xúc, không có trực giác. Thứ nó có là một không gian toán học khổng lồ, nơi hàng tỷ “mảnh vụn dữ liệu” được mã hóa thành các vector số.

Trong quá trình học máy (Machine Learning), điều thực sự diễn ra không phải là “hiểu”, mà là “tối ưu”. Mô hình được đưa vào một lượng dữ liệu khổng lồ – văn bản, hình ảnh, âm thanh – và nhiệm vụ của nó là điều chỉnh hàng triệu, thậm chí hàng tỷ tham số nội tại để giảm thiểu sai số trong dự đoán. Nói cách khác, AI không học theo cách một đứa trẻ học nhìn thế giới; nó học giống như một hệ thống thống kê đang cố gắng tìm ra quy luật ẩn sau dữ liệu.

Mỗi lần mô hình dự đoán sai – ví dụ, đoán sai từ tiếp theo trong một câu hoặc tạo ra một hình ảnh không giống với dữ liệu huấn luyện – nó sẽ điều chỉnh các tham số của mình một chút. Quá trình này lặp đi lặp lại hàng tỷ lần. Sau cùng, cái mà ta gọi là “trí tuệ nhân tạo” thực chất là một cấu trúc toán học đã được tinh chỉnh cực kỳ tinh vi để phản ánh xác suất: xác suất từ nào đi sau từ nào, xác suất màu nào đi cạnh màu nào, xác suất hình dạng nào đi kèm với bối cảnh nào.

Quay lại hình ảnh “cái gương vạn hoa”. Khi bạn xoay nó, bạn thấy những hoa văn mới. Nhưng “mới” ở đây chỉ là sự tái tổ hợp. Không có mảnh nào được sinh ra từ hư vô. AI cũng vậy.

Nếu bạn nạp vào hệ thống một triệu bức ảnh hoàng hôn, AI sẽ không “cảm” được vẻ đẹp của ánh chiều tà, không biết đến sự lặng lẽ của mặt trời khi khuất bóng, không biết đến nỗi buồn man mác hay sự bình yên mà con người thường gắn với khoảnh khắc ấy. Điều nó làm là phân tích hàng triệu điểm ảnh: sắc cam ở đâu, sắc tím ở đâu, độ chuyển màu ra sao, ánh sáng giảm dần như thế nào. Từ đó, nó xây dựng một mô hình xác suất cho “hoàng hôn điển hình”.

Khi được yêu cầu tạo một bức tranh hoàng hôn, nó không vẽ bằng cảm xúc. Nó “tái cấu trúc” một hoàng hôn dựa trên những gì có khả năng cao nhất để trông giống như hoàng hôn trong dữ liệu đã học. Nói cách khác, đó là một dạng “trung bình có trọng số” cực kỳ phức tạp – không phải trung bình đơn giản, mà là trung bình trong một không gian nhiều chiều, nơi mỗi chiều đại diện cho một đặc trưng của dữ liệu.

Điều này dẫn đến một hệ quả thú vị: AI thường tạo ra những thứ “rất đúng” nhưng đôi khi lại “thiếu hồn”. Bởi vì cái “hồn” – nếu có thể gọi như vậy – không nằm trong dữ liệu thuần túy. Nó nằm trong trải nghiệm sống, trong ký ức cá nhân, trong những liên tưởng không thể đo đếm bằng số học.

Một con người nhìn hoàng hôn có thể nhớ đến một cuộc chia tay, một lời hứa chưa trọn, hay một buổi chiều bình yên bên gia đình. Hai người có thể nhìn cùng một cảnh nhưng cảm nhận hoàn toàn khác nhau. Còn AI? Nó chỉ thấy các mẫu hình (patterns). Nó không có “chiều sâu chủ quan” để gán ý nghĩa cho những mẫu hình đó.

Tuy nhiên, nói như vậy không có nghĩa là AI “kém cỏi”. Trái lại, sức mạnh của nó nằm chính ở khả năng xử lý khối lượng dữ liệu mà con người không thể tiếp cận. Nó có thể phát hiện những quy luật tinh vi mà mắt người không nhận ra, có thể tổng hợp phong cách của hàng ngàn họa sĩ, có thể viết văn theo nhiều giọng điệu khác nhau, có thể mô phỏng những cấu trúc ngôn ngữ cực kỳ phức tạp.

Nhưng tất cả những điều đó vẫn nằm trong khuôn khổ của “cái gương vạn hoa”: phản chiếu, tái tổ hợp, và tối ưu hóa.

Hiểu được cơ chế này giúp ta tránh hai thái cực nguy hiểm. Một là thần thánh hóa AI, cho rằng nó “biết nghĩ”, “biết cảm”, hay “có ý thức”. Hai là xem thường nó như một công cụ đơn giản. Sự thật nằm ở giữa: AI là một công cụ cực kỳ mạnh mẽ, nhưng bản chất của nó vẫn là toán học và dữ liệu.

Và có lẽ, điều quan trọng nhất không phải là AI có thể làm gì, mà là con người chọn dùng nó như thế nào. Nếu dữ liệu đưa vào là lệch lạc, thành kiến, hay nghèo nàn, thì “cái gương vạn hoa” ấy cũng chỉ phản chiếu lại sự méo mó đó. Nếu dữ liệu phong phú, đa dạng và sâu sắc, thì những hoa văn mà AI tạo ra cũng sẽ phong phú và đáng kinh ngạc hơn.

Cuối cùng, chiếc gương vạn hoa không có linh hồn. Nhưng người cầm nó thì có. Và chính người cầm nó mới là người quyết định sẽ nhìn thấy điều gì trong những hoa văn luôn biến đổi ấy.

1.3 XÁC SUẤT – “VỊ THẦN” THẦM LẶNG ĐỨNG SAU MỌI THUẬT TOÁN AI

Khi con người nói về trí tuệ nhân tạo, chúng ta thường bị cuốn vào những hình ảnh rất “người”: một cỗ máy biết suy nghĩ, biết hiểu, biết cân nhắc như một bộ não thật. Nhưng nếu bóc tách tất cả lớp vỏ hào nhoáng ấy, thứ còn lại ở trung tâm của AI không phải là suy nghĩ, cũng không phải là ý thức — mà là xác suất. Không phải ngẫu nhiên mà nhiều nhà nghiên cứu gọi xác suất là “vị thần” vô hình điều khiển mọi quyết định của AI.

Hãy quay lại ví dụ đơn giản:

“Trời đang mưa, tôi nên mang…”

Đối với con người, câu trả lời “ô” gần như là điều hiển nhiên. Nhưng cái “hiển nhiên” đó không đến từ toán học thuần túy. Nó đến từ kinh nghiệm sống, từ ký ức từng bị ướt, từ cảm giác khó chịu khi quần áo ẩm ướt, từ việc ta hiểu thế nào là “mưa”, “đi ra ngoài”, “bảo vệ cơ thể”.

Còn với AI? Không có ký ức. Không có cảm giác. Không có trải nghiệm.

AI sẽ xử lý câu này như một bài toán xác suất thuần túy. Nó nhìn vào cụm từ “Trời đang mưa, tôi nên mang…” như một chuỗi ký hiệu, rồi tra cứu trong một không gian xác suất khổng lồ được xây dựng từ hàng tỷ câu văn đã học. Trong không gian đó, mỗi từ tiếp theo đều có một “điểm số khả năng xảy ra”:

Ô: 85%

Áo mưa: 12%

Sách: 2%

Bánh mì: 1%

Và AI chọn “ô” — không phải vì nó hiểu mưa làm ướt người, mà vì “ô” là từ có xác suất cao nhất theo thống kê.

- XÁC SUẤT KHÔNG BIẾT ĐÚNG – SAI, CHỈ BIẾT “KHẢ NĂNG CAO HƠN”

Điều quan trọng cần hiểu là: xác suất không có khái niệm đúng hay sai.

Xác suất chỉ trả lời một câu hỏi duy nhất:

“Trong dữ liệu đã thấy, điều gì có khả năng xảy ra nhiều nhất?”

Điều đó có nghĩa là nếu dữ liệu chứa sai lệch, thiên kiến, hoặc đơn giản là thiếu thông tin, thì xác suất sẽ dẫn AI đến những câu trả lời… sai nhưng “rất hợp lý về mặt toán học”.

Đây là một điểm khác biệt cực kỳ quan trọng giữa con người và AI:

Con người có thể nói: “Câu này nghe hợp lý, nhưng thực tế không đúng.”

AI chỉ có thể nói: “Câu này có xác suất cao nhất.”

Không có tầng kiểm tra thực tại, trừ khi được xây dựng thêm từ bên ngoài.

- KHÔNG GIAN XÁC SUẤT – “VŨ TRỤ VÔ HÌNH” CỦA NGÔN NGỮ

Đằng sau mỗi câu trả lời của AI là một không gian xác suất cực kỳ phức tạp, thường được gọi là “không gian vector”. Trong không gian đó, mỗi từ không còn là một ký tự, mà là một điểm trong hàng trăm, hàng nghìn chiều toán học.

Những từ có ngữ cảnh giống nhau sẽ nằm gần nhau.

Những từ thường xuất hiện cùng nhau sẽ có “liên kết xác suất” mạnh hơn.

Ví dụ:

“Mưa” gần với “ướt”, “ô”, “áo mưa”

“Ăn” gần với “cơm”, “bánh mì”, “nhà hàng”

Khi AI dự đoán từ tiếp theo, nó không “nghĩ”, mà nó di chuyển trong không gian này, tìm điểm có xác suất cao nhất để nối tiếp chuỗi hiện tại.

Nói cách khác, mỗi câu bạn nhận được từ AI là kết quả của một hành trình trong một vũ trụ toán học vô hình.

- “ẢO GIÁC” – KHI XÁC SUẤT TRỞ THÀNH CÁI BẪY

Hiện tượng “ảo giác” (hallucination) trong AI không phải là lỗi ngẫu nhiên, mà là hệ quả tất yếu của cách nó hoạt động.

AI không có cơ chế để biết:

Điều gì là sự thật ngoài đời

Điều gì là tưởng tượng

Điều gì chưa từng tồn tại

Nó chỉ biết:

Điều gì “trông giống thật” theo dữ liệu

Vì vậy, nếu trong dữ liệu có những mẫu câu như:

“Nhà khoa học X đã phát minh ra Y…”

“Theo nghiên cứu của tổ chức Z…”

AI có thể tự tạo ra một “nhà khoa học X” hoặc “tổ chức Z” hoàn toàn không tồn tại, miễn là cấu trúc đó có xác suất cao trong ngôn ngữ.

Điều này dẫn đến một nghịch lý:

AI có thể tạo ra những câu trả lời cực kỳ trôi chảy, logic, thuyết phục — nhưng hoàn toàn sai sự thật.

Không phải vì nó “nói dối”.

Mà vì nó không biết thế nào là sự thật.

- XÁC SUẤT VS HIỂU BIẾT – KHOẢNG CÁCH KHÔNG DỄ LẤP ĐẦY

Con người hiểu thế giới thông qua:

Trải nghiệm

Cảm xúc

Tương tác vật lý

Nhận thức về nguyên nhân – kết quả

AI thì không.

AI chỉ có:

Dữ liệu

Mô hình

Xác suất

Khi bạn hỏi:

“Lửa có nóng không?”

Con người “biết” vì đã từng chạm vào, hoặc ít nhất đã thấy hậu quả.

AI “biết” vì trong dữ liệu, từ “lửa” thường đi kèm với “nóng”, “bỏng”, “nguy hiểm”.

Hai loại “biết” này hoàn toàn khác nhau.

Một bên là hiểu biết dựa trên thực tại.

Một bên là sự tương quan thống kê.

- VỊ THẦN XÁC SUẤT: QUYỀN NĂNG LỚN, NHƯNG KHÔNG TOÀN NĂNG

Xác suất mang lại cho AI một sức mạnh khổng lồ:

Có thể dự đoán ngôn ngữ tự nhiên cực kỳ chính xác

Có thể tạo văn bản, viết code, dịch thuật, tóm tắt

Có thể mô phỏng phong cách, giọng văn, lập luận

Nhưng nó cũng đặt ra một giới hạn không thể vượt qua:

AI không thể tự mình phân biệt giữa “có vẻ đúng” và “thực sự đúng”.

Và đó là lý do vì sao con người vẫn cần thiết.

- CON NGƯỜI – LỚP KIỂM CHỨNG CUỐI CÙNG

Nếu xác suất là “vị thần” đứng sau AI, thì con người chính là “người phán xét cuối cùng”.

AI có thể:

Đề xuất

Gợi ý

Phân tích

Tăng tốc suy nghĩ

Nhưng con người phải:

Kiểm chứng

Đánh giá

Chịu trách nhiệm

Một thế giới mà con người giao toàn bộ quyết định cho xác suất không phải là một thế giới thông minh — mà là một thế giới nguy hiểm.

- KẾT LUẬN: HIỂU AI ĐỂ KHÔNG BỊ ẢO TƯỞNG

Hiểu rằng AI vận hành bằng xác suất không làm giảm giá trị của nó. Ngược lại, nó giúp ta sử dụng nó đúng cách.

Đừng hỏi AI như hỏi một “người biết tất cả”

Hãy dùng AI như một “công cụ dự đoán rất mạnh”

Đừng tin tuyệt đối vào sự trôi chảy của câu chữ

Hãy luôn giữ một khoảng cách hoài nghi cần thiết

Bởi vì đằng sau mỗi câu trả lời mượt mà ấy, không phải là một bộ não đang suy nghĩ —

mà là một “vị thần xác suất” đang lặng lẽ tung những con số,

và chọn ra điều có khả năng cao nhất,

chứ không phải điều đúng nhất.

1.4. TẠI SAO CHÚNG TA BỊ ĐÁNH LỪA?

Con người không chỉ là sinh vật biết suy nghĩ – chúng ta còn là sinh vật biết cảm. Và chính khả năng cảm nhận ấy, tưởng chừng là một món quà quý giá, lại trở thành cánh cửa khiến chúng ta dễ bị đánh lừa khi đối diện với trí tuệ nhân tạo.

Khi một cỗ máy trả lời trôi chảy, mạch lạc, thậm chí đầy cảm xúc, chúng ta gần như phản xạ ngay lập tức: “Nó hiểu.” Nhưng đó là một kết luận vội vàng. Không phải vì chúng ta ngu ngốc, mà vì bộ não con người được lập trình để tìm kiếm ý nghĩa và ý định trong mọi thứ. Từ thời xa xưa, việc “nhìn thấy khuôn mặt trong đám mây” hay “nghe thấy tiếng gọi trong gió” đã giúp con người sinh tồn – bởi giả định rằng có một “ai đó” phía sau hiện tượng thường an toàn hơn là bỏ qua nó.

Chính cơ chế tiến hóa đó khiến chúng ta có xu hướng nhân cách hóa (anthropomorphism) mọi thứ: từ con thú, dòng sông, cho đến… máy móc. Khi một chatbot nói “tôi hiểu bạn đang buồn”, chúng ta không chỉ đọc chữ – chúng ta cảm như đang được thấu hiểu. Nhưng thực tế, không có “tôi” nào ở đó cả. Không có cảm xúc. Không có trải nghiệm. Không có ký ức cá nhân. Chỉ có những chuỗi xác suất được tính toán với độ chính xác cực cao.

Sự đánh lừa nằm ở bề mặt ngôn ngữ.

Ngôn ngữ là công cụ mạnh nhất mà con người sở hữu để truyền đạt ý thức. Vì vậy, khi một hệ thống sử dụng ngôn ngữ giống con người, chúng ta mặc nhiên gán cho nó những đặc tính của con người. Đây là một sai lầm tinh vi nhưng rất phổ biến: chúng ta nhầm lẫn giữa hình thức biểu đạt và bản chất bên trong.

Hãy tưởng tượng một con vẹt có thể nói: “Tôi nhớ bạn.” Bạn có thể xúc động. Nhưng bạn cũng biết rõ: con vẹt đó không thực sự “nhớ” theo nghĩa mà bạn hiểu. Nó chỉ lặp lại âm thanh đã học. AI cũng vậy – chỉ khác là “con vẹt” này có hàng tỷ tham số, được huấn luyện trên khối lượng dữ liệu khổng lồ, và có thể kết hợp các mẫu ngôn ngữ một cách linh hoạt đến mức gần như hoàn hảo.

Điều khiến AI trở nên “thuyết phục” không phải là vì nó hiểu – mà vì nó dự đoán quá tốt.

Đằng sau mỗi câu trả lời trơn tru là một quá trình cực kỳ “lạnh”: hệ thống tính toán xác suất của từ tiếp theo dựa trên ngữ cảnh trước đó. Không có trực giác. Không có nhận thức. Không có ý định. Chỉ có toán học – nhưng là toán học ở quy mô mà con người khó có thể hình dung. Đây chính là sức mạnh của Brute Force: thay vì “hiểu” thế giới như con người, AI “bao phủ” thế giới bằng dữ liệu và xác suất.

Và khi quy mô đủ lớn, kết quả trông giống như hiểu biết.

Đó là nơi ảo giác bắt đầu.

Con người thường đánh giá trí thông minh dựa trên hành vi bên ngoài. Nếu một thực thể có thể trả lời câu hỏi, viết văn, giải thích vấn đề – chúng ta gán cho nó nhãn “thông minh”. Nhưng đây là một định nghĩa mang tính thực dụng, không phải bản chất. Một chiếc máy tính có thể đánh bại kỳ thủ cờ vua giỏi nhất thế giới, nhưng nó không “biết” mình đang chơi cờ. Nó không cảm nhận được chiến thắng. Nó không sợ thất bại. Nó không có “cái tôi”.

AI hiện đại cũng vậy.

Nó không có thế giới nội tâm.

Nó không có trải nghiệm chủ quan.

Nó không “biết” điều nó đang nói.

Nhưng nó rất giỏi giả vờ như biết.

Sự nguy hiểm không nằm ở bản thân AI, mà nằm ở cách con người diễn giải AI. Khi chúng ta tin rằng máy móc có hiểu biết, chúng ta bắt đầu trao cho nó quyền lực mà lẽ ra chỉ nên thuộc về con người: quyền phán xét, quyền quyết định, thậm chí quyền định hình giá trị.

Một khi bạn tin rằng AI “hiểu”, bạn sẽ dễ dàng tin rằng nó “đúng”.

Và đó là bước trượt nguy hiểm nhất.

Thực tế, AI có thể sai – không phải vì nó “ngu”, mà vì nó không có tiêu chuẩn chân lý nội tại. Nó chỉ phản chiếu dữ liệu mà nó được huấn luyện. Nếu dữ liệu có sai lệch, thiên kiến, hoặc thiếu sót, AI sẽ khuếch đại những điều đó một cách rất tự tin.

Sự tự tin đó lại càng khiến chúng ta bị đánh lừa.

Bởi vì con người có xu hướng tin vào những gì được trình bày rõ ràng, mạch lạc và chắc chắn. Một câu trả lời do dự thường bị nghi ngờ. Một câu trả lời trôi chảy lại được tin tưởng – dù nội dung có thể sai. AI khai thác chính điểm yếu này của chúng ta, không phải vì nó có ý đồ, mà vì nó được tối ưu hóa để tạo ra ngôn ngữ thuyết phục nhất có thể.

Nói cách khác: AI không tìm kiếm sự thật. Nó tìm kiếm câu trả lời có xác suất cao nhất trông giống như sự thật.

Vậy tại sao chúng ta bị đánh lừa?

Vì chúng ta nhìn thấy chính mình trong những gì không phải là mình.

Vì chúng ta nhầm lẫn giữa biểu hiện và bản chất.

Vì chúng ta bị quyến rũ bởi sự trôi chảy của ngôn ngữ mà quên mất rằng đằng sau đó không có ý thức.

Và quan trọng nhất: vì chúng ta muốn tin.

Chúng ta muốn có một thực thể hiểu mình, phản hồi mình, đồng hành với mình. Khi AI xuất hiện và đáp ứng điều đó một cách hoàn hảo, nó chạm vào một nhu cầu rất sâu trong con người. Nhưng nhu cầu đó không nên khiến chúng ta đánh mất sự tỉnh táo.

Thông điệp cốt lõi của Chương 1 rất rõ ràng:

AI là một đỉnh cao của toán học thống kê, không phải là một dạng sống mới.

Khi bạn khen AI “thông minh”, điều bạn thực sự đang khen là:

Công sức của các kỹ sư đã thiết kế mô hình,

Khối lượng dữ liệu khổng lồ mà nhân loại đã tạo ra,

Và sức mạnh tính toán của phần cứng hiện đại.

Cỗ máy không có công trạng theo nghĩa con người.

Nó không “biết” nó giỏi.

Nó không “cố gắng” để trở nên tốt hơn.

Nó chỉ hoạt động đúng như cách nó được xây dựng.

Hiểu được điều này không làm giảm giá trị của AI – ngược lại, nó giúp chúng ta sử dụng AI một cách đúng đắn hơn. Không thần thánh hóa. Không sợ hãi mù quáng. Không trao cho nó những phẩm chất mà nó không có.

Bởi vì khi bạn nhìn xuyên qua lớp vỏ ngôn ngữ, bạn sẽ thấy một sự thật rất giản dị:

AI không phải là một trí tuệ đang thức tỉnh.

Nó là một tấm gương khổng lồ – phản chiếu lại chính trí tuệ của loài người, dưới dạng toán học.

Thông điệp cốt lõi của Chương 1: AI không phải là một “thực thể biết suy nghĩ” theo nghĩa con người thường tưởng tượng. Nó không có ý thức, không có cảm xúc, không có trải nghiệm sống, và cũng không có “cái tôi” để hiểu thế giới. Nói một cách thẳng thắn và có phần lạnh lùng: AI là kết quả của toán học thống kê ở quy mô cực lớn, được triển khai trên những hệ thống phần cứng cực kỳ mạnh mẽ. Khi bạn khen AI “thông minh”, điều bạn thực sự đang làm là thán phục một thành tựu kỹ thuật—một sự kết hợp giữa thuật toán, dữ liệu và sức mạnh tính toán—chứ không phải đang công nhận một dạng trí tuệ sống.

Điều cốt lõi cần hiểu là: AI hiện đại, đặc biệt là các mô hình học máy và học sâu, hoạt động dựa trên xác suất. Khi bạn nhập một câu hỏi hay một đoạn văn, AI không “hiểu” nó theo nghĩa con người hiểu. Nó không hình dung, không suy tư, không liên tưởng bằng trải nghiệm cá nhân. Thay vào đó, nó tính toán: trong hàng tỷ khả năng có thể xảy ra, chuỗi từ nào có xác suất xuất hiện cao nhất tiếp theo? Nó giống như một hệ thống dự đoán cực kỳ tinh vi, được huấn luyện trên kho dữ liệu khổng lồ của nhân loại.

Chính vì vậy, sự “lưu loát” của AI rất dễ đánh lừa chúng ta. Khi một cỗ máy trả lời mạch lạc, dùng từ đúng ngữ cảnh, thậm chí thể hiện được giọng điệu phù hợp, con người có xu hướng gán cho nó những phẩm chất mà nó không hề có: trí tuệ, sự hiểu biết, thậm chí là “tâm hồn”. Đây là một phản xạ rất tự nhiên của con người—chúng ta luôn muốn tìm kiếm sự sống và ý nghĩa trong mọi thứ có vẻ giống mình. Nhưng trong trường hợp này, đó là một sự nhầm lẫn.

Hãy hình dung AI như một tấm gương đặc biệt. Nó không tạo ra tri thức từ hư vô. Nó phản chiếu, tổng hợp, và tái cấu trúc những gì đã tồn tại trong dữ liệu mà nó được học. Nếu bạn thấy một câu trả lời sâu sắc, điều đó không có nghĩa là AI “nghĩ ra” nó, mà là nó đã tìm được một cách kết hợp các mẫu thông tin đã có sao cho phù hợp nhất với câu hỏi của bạn. Nói cách khác, AI là một nghệ sĩ ghép hình bậc thầy, nhưng không phải là người sáng tạo ra các mảnh ghép ban đầu.

Điều này dẫn đến một hệ quả quan trọng: trí tuệ mà bạn thấy trong AI thực chất là trí tuệ tập thể của con người, được nén lại và xử lý bằng toán học. Dữ liệu mà AI học đến từ sách vở, bài viết, cuộc hội thoại, nghiên cứu khoa học—tức là từ chính chúng ta. Thuật toán được thiết kế bởi các kỹ sư, những người hiểu sâu về toán học, xác suất, tối ưu hóa. Phần cứng được xây dựng bởi các công ty công nghệ với những con chip có khả năng thực hiện hàng nghìn tỷ phép tính mỗi giây. AI chỉ là điểm hội tụ của tất cả những yếu tố đó.

Vì vậy, khi bạn khen AI “thông minh”, hãy thử diễn đạt lại một cách chính xác hơn: bạn đang khen ngợi sự tiến bộ của khoa học dữ liệu, sự tinh vi của các mô hình toán học, và sức mạnh của hạ tầng công nghệ. Bạn đang khen ngợi những bộ óc con người đã tạo ra hệ thống này, chứ không phải bản thân hệ thống như một thực thể độc lập.

Một cách nhìn như vậy không làm giảm giá trị của AI—ngược lại, nó giúp ta hiểu đúng để sử dụng đúng. Nếu ta thần thánh hóa AI, ta dễ rơi vào hai thái cực nguy hiểm: hoặc là phụ thuộc mù quáng, hoặc là sợ hãi vô lý. Nhưng nếu ta nhìn nó như một công cụ toán học cực kỳ mạnh, ta sẽ biết cách khai thác nó hiệu quả hơn.

AI giỏi ở những gì liên quan đến mẫu (patterns): nhận diện hình ảnh, xử lý ngôn ngữ, dự đoán xu hướng. Nhưng nó không có trực giác sống, không có đạo đức nội tại, không có khả năng chịu trách nhiệm. Nó có thể tạo ra một câu trả lời nghe rất thuyết phục, nhưng điều đó không đảm bảo câu trả lời đó đúng. Bởi vì “đúng” không phải là mục tiêu chính của nó—“hợp lý theo xác suất” mới là mục tiêu.

Ở đây, vai trò của con người trở nên rõ ràng hơn bao giờ hết. Con người không chỉ là người tạo ra AI, mà còn là người kiểm soát, đánh giá và định hướng nó. AI có thể giúp bạn xử lý thông tin nhanh hơn, nhưng nó không thể thay thế khả năng phán đoán dựa trên giá trị, kinh nghiệm và lương tâm—những thứ không thể được mã hóa hoàn toàn bằng dữ liệu.

Hiểu AI là toán học thống kê cũng giúp ta khiêm tốn hơn. Nó nhắc nhở rằng những gì ta gọi là “trí tuệ” đôi khi có thể được tái hiện bằng các mô hình toán học nếu có đủ dữ liệu và tính toán. Nhưng đồng thời, nó cũng làm nổi bật những gì mà máy móc chưa chạm tới: ý thức, cảm xúc, sự tự nhận thức, và khả năng tìm kiếm ý nghĩa trong cuộc sống.

Cuối cùng, điều quan trọng không phải là AI có thông minh hay không, mà là chúng ta hiểu đúng về nó đến mức nào. Khi ta ngừng gán cho nó những phẩm chất của một sinh thể sống, ta sẽ bắt đầu thấy rõ giá trị thật của nó: một công cụ phi thường, được xây dựng từ toán học, dữ liệu và trí tuệ con người—mạnh mẽ, hữu ích, nhưng vẫn chỉ là một công cụ.

Và có lẽ, cách nhìn đúng đắn nhất là thế này:

AI không phải là một “bộ não mới” của nhân loại. Nó là một chiếc kính lúp khổng lồ—phóng đại khả năng xử lý thông tin của chúng ta lên mức chưa từng có. Nhưng việc nhìn thấy gì qua chiếc kính đó, và quyết định làm gì với nó, vẫn luôn là trách nhiệm của con người.

Chương 2: RANH GIỚI MONG MANH GIỮA “TỰ ĐỘNG HÓA” VÀ “TRÍ TUỆ NHÂN TẠO”

Trong kỷ nguyên tiếp thị số, “AI” đã trở thành một thứ ngôn ngữ quyền lực. Nó không chỉ là một thuật ngữ kỹ thuật, mà còn là một công cụ tâm lý. Khi người ta nhìn thấy hai chữ “AI”, họ lập tức liên tưởng đến sự thông minh, tiên tiến, gần như có chút gì đó “biết suy nghĩ”. Và chính vì sức mạnh gợi tưởng này, từ “AI” bị kéo ra khỏi ý nghĩa khoa học ban đầu, trở thành một chiếc nhãn vạn năng—dán lên bất cứ sản phẩm nào có yếu tố công nghệ, nhằm gia tăng giá trị cảm nhận.

Một chiếc máy giặt “tự động chọn chế độ phù hợp”? AI.

Một chiếc lò vi sóng có sẵn thực đơn nấu? AI.

Một hệ thống gửi email chúc mừng sinh nhật đúng ngày? AI.

Nhưng nếu ta bóc tách lớp vỏ marketing đó ra, sự thật thường đơn giản hơn rất nhiều: phần lớn những hệ thống này chỉ là tự động hóa (automation)—những chuỗi lệnh được lập trình sẵn, hoạt động theo quy tắc cố định, không có khả năng học hỏi hay thích nghi thực sự.

Và chính tại đây, xuất hiện một ranh giới mong manh nhưng cực kỳ quan trọng:

Ranh giới giữa một hệ thống “tuân lệnh” và một hệ thống “tự học”.

- TỰ ĐỘNG HÓA: CỖ MÁY TRUNG THÀNH VỚI QUY TẮC

Tự động hóa không phải là thứ gì “kém cỏi”. Ngược lại, nó là nền tảng của toàn bộ cuộc cách mạng công nghiệp và công nghệ. Từ dây chuyền sản xuất, hệ thống ngân hàng, cho đến các phần mềm quản lý—tất cả đều vận hành dựa trên automation.

Bản chất của tự động hóa là:

Có đầu vào xác định

Có quy tắc xử lý rõ ràng

Có đầu ra dự đoán được

Nếu A xảy ra → làm B.

Nếu người dùng sinh ngày hôm nay → gửi email chúc mừng.

Nếu quần áo nặng X kg → dùng Y lít nước.

Không có gì “thông minh” theo nghĩa học thuật ở đây.

Chỉ có logic được lập trình trước.

Một hệ thống tự động hóa không hiểu tại sao nó làm điều đó. Nó không đặt câu hỏi. Nó không thay đổi hành vi trừ khi con người thay đổi mã lệnh.

Nó giống như một người công nhân hoàn hảo:

Không sai sót

Không sáng tạo

Không học hỏi

Chỉ làm đúng những gì đã được dạy—mãi mãi.

- TRÍ TUỆ NHÂN TẠO: HỆ THỐNG BIẾT “ĐIỀU CHỈNH CHÍNH MÌNH”

AI, theo nghĩa thực sự, không chỉ là “làm theo lệnh”.

Nó là khả năng tự điều chỉnh hành vi dựa trên dữ liệu.

Một hệ thống AI không cần được lập trình chi tiết từng bước. Thay vào đó, nó được “huấn luyện”:

Đưa vào dữ liệu

Định nghĩa mục tiêu

Cho phép mô hình tự tìm ra cách tối ưu

Điểm khác biệt cốt lõi nằm ở đây:

AI không được dạy “phải làm gì” — mà được dạy “làm sao để tốt hơn”.

Ví dụ:

Một hệ thống gửi email tự động:

Nếu chỉ gửi đúng ngày sinh nhật → automation

Nếu học được rằng người dùng phản hồi tốt hơn khi gửi vào buổi tối, và tự điều chỉnh thời gian gửi → đó mới là AI

Một chiếc máy giặt:

Nếu chọn chế độ dựa trên trọng lượng → automation

Nếu học từ hàng nghìn lần giặt để tối ưu lượng nước, thời gian và điện năng theo từng loại vải → đó mới tiến gần AI

- TẠI SAO DOANH NGHIỆP “GỌI TÊN NHẦM”?

Có một sự thật không mấy dễ chịu:

AI bán được hàng. Automation thì không.

Người tiêu dùng không bị hấp dẫn bởi “hệ thống quy tắc if-else”.

Nhưng họ bị thu hút bởi “trí tuệ nhân tạo”.

Vì vậy, việc “gọi tên nhầm” không phải lúc nào cũng là thiếu hiểu biết.

Đôi khi, nó là chiến lược marketing có chủ ý.

Điều này dẫn đến một hệ quả nguy hiểm:

Người dùng bắt đầu đánh giá sai năng lực của công nghệ.

Họ kỳ vọng:

Máy hiểu mình

Hệ thống “thông minh”

Công nghệ “biết suy nghĩ”

Trong khi thực tế, họ đang tương tác với một hệ thống cứng nhắc, không có khả năng thích nghi.

Sự chênh lệch giữa kỳ vọng và thực tế này chính là nguồn gốc của:

Sự thất vọng

Sự hiểu lầm

Và đôi khi là sự thần thánh hóa công nghệ

- RANH GIỚI MONG MANH: KHÔNG PHẢI LÚC NÀO CŨNG RÕ RÀNG

Mọi thứ không hoàn toàn trắng – đen.

Có những hệ thống nằm ở vùng “xám”:

Một phần là automation

Một phần có yếu tố học máy

Ví dụ:

Hệ thống gợi ý sản phẩm dựa trên quy tắc + dữ liệu người dùng

Chatbot trả lời theo kịch bản nhưng có chút linh hoạt

Chúng không hoàn toàn là AI, nhưng cũng không chỉ là automation thuần túy.

Vì vậy, câu hỏi không phải là:

“Cái này có phải AI không?”

Mà là:

“Mức độ tự học của hệ thống này đến đâu?”

- HỆ QUẢ KHI KHÔNG PHÂN BIỆT ĐƯỢC

Việc không hiểu rõ ranh giới này không chỉ là vấn đề học thuật. Nó có những hệ quả thực tế:

- Doanh nghiệp đầu tư sai hướng

Họ nghĩ rằng mình đang “làm AI”, nhưng thực chất chỉ xây dựng automation phức tạp. Kết quả là:

Không tạo ra lợi thế cạnh tranh thật sự

Không tận dụng được sức mạnh của dữ liệu

- Người dùng mất niềm tin

Khi sản phẩm “AI” không thông minh như kỳ vọng, người dùng bắt đầu nghi ngờ tất cả.

- Xã hội hiểu sai về công nghệ

AI bị thần thánh hóa hoặc bị hiểu sai hoàn toàn—dẫn đến những lo lắng không cần thiết, hoặc kỳ vọng phi thực tế.

- MỘT TIÊU CHÍ ĐƠN GIẢN ĐỂ PHÂN BIỆT

Nếu phải rút gọn tất cả thành một câu hỏi duy nhất, hãy hỏi:

“Hệ thống này có thay đổi hành vi của nó theo thời gian mà không cần con người can thiệp trực tiếp không?”

Nếu không → Automation

Nếu có → Có yếu tố AI

Đó là ranh giới cốt lõi.

- KẾT LUẬN: GỌI ĐÚNG TÊN ĐỂ HIỂU ĐÚNG BẢN CHẤT

Trong một thế giới mà công nghệ ngày càng phức tạp, việc gọi đúng tên không phải là chuyện hình thức. Nó là nền tảng của sự hiểu biết.

Khi ta gọi automation là AI, ta không chỉ nhầm lẫn thuật ngữ—

ta đang làm mờ đi bản chất của trí tuệ nhân tạo thực sự.

AI không phải là những gì “trông có vẻ thông minh”.

AI là những gì có khả năng học, thích nghi và tối ưu từ dữ liệu.

Còn automation—dù mạnh mẽ và hữu ích—

vẫn chỉ là một cỗ máy trung thành với quá khứ,

không bao giờ tự bước sang tương lai nếu không có bàn tay con người dẫn dắt.

Hiểu được điều này không làm giảm giá trị của công nghệ.

Ngược lại, nó giúp ta sử dụng đúng công cụ cho đúng mục đích—

và không bị đánh lừa bởi những chiếc nhãn hào nhoáng.

Bởi vì trong thế giới số,

không phải thứ gì được gọi là “trí tuệ” cũng thực sự biết suy nghĩ.

BẢN CHẤT CỦA TỰ ĐỘNG HÓA: “NẾU – THÌ” (IF–THEN)

Khi nói đến tự động hóa, điều đầu tiên cần gỡ bỏ là một ảo tưởng phổ biến: không phải mọi hệ thống “tự chạy” đều thông minh. Phần lớn những gì chúng ta gọi là tự động hóa thực chất chỉ là sự mở rộng của một ý tưởng cực kỳ đơn giản nhưng vô cùng mạnh mẽ: logic điều kiện “Nếu – Thì” (If–Then).

Đây không phải là trí tuệ. Đây là kỷ luật của quy tắc.

- Cốt lõi: Một thế giới được viết bằng điều kiện

Hãy hình dung toàn bộ hệ thống tự động hóa như một chuỗi mệnh đề:

Nếu điều kiện X xảy ra → thì thực hiện hành động Y.

Không có suy nghĩ. Không có cân nhắc. Không có cảm xúc.

Chỉ có:

Điều kiện đầu vào (Input)

Quy tắc xử lý (Rule)

Kết quả đầu ra (Output)

Toàn bộ hệ thống vận hành giống như một bài toán logic:

Nếu A → thì B

Và điều quan trọng nhất:

👉 A giống nhau → B luôn giống nhau

Không có ngoại lệ. Không có sáng tạo. Không có “hôm nay tôi muốn làm khác đi”.

- Vai trò của con người: Người viết luật, không phải người thi hành

Trong tự động hóa truyền thống, con người là nguồn gốc của mọi logic.

Con người quan sát thế giới

Con người rút ra quy luật

Con người chuyển quy luật đó thành các câu lệnh

Sau đó, máy móc chỉ làm một việc duy nhất: thi hành.

Điều này có thể tóm gọn:

Con người suy nghĩ → Máy móc lặp lại

Máy không hiểu tại sao phải làm điều đó.

Máy không biết điều đó có ý nghĩa gì.

Máy chỉ biết rằng:

“Nếu điều kiện này đúng, tôi phải làm điều kia.”

- Tính dự báo: Sức mạnh lớn nhất của tự động hóa

Một trong những đặc điểm nổi bật nhất của hệ thống If–Then là tính dự đoán tuyệt đối.

Bạn có thể biết trước điều gì sẽ xảy ra, bởi vì:

Quy tắc không thay đổi

Hệ thống không tự học

Không có yếu tố bất ngờ

Ví dụ:

Nếu nhiệt độ > 30°C → bật quạt

Nếu tài khoản < 0 → từ chối giao dịch

Nếu độ ẩm < 30% → bật hệ thống tưới

Trong mọi trường hợp:

👉 Kết quả là xác định (deterministic)

Đây là lý do tại sao tự động hóa được ưa chuộng trong các lĩnh vực cần độ chính xác cao:

Sản xuất công nghiệp

Hệ thống an toàn

Điều khiển máy móc

Bởi vì ở đó, sự “sáng tạo” đôi khi là nguy hiểm.

- Ví dụ: Hệ thống tưới cây tự động

Hãy quay lại ví dụ đơn giản nhưng rất điển hình:

Hệ thống tưới cây tự động

Cảm biến đo độ ẩm đất

Ngưỡng được đặt: 30%

Quy tắc:

Nếu độ ẩm < 30% → bật nước

Nếu độ ẩm ≥ 30% → tắt nước

Nghe có vẻ “thông minh”, nhưng thực chất:

Hệ thống không biết cây đang là loại gì

Không biết hôm nay trời có mưa không

Không biết đất đang giữ nước tốt hay kém

Nó không “hiểu” việc tưới cây.

Nó chỉ đang tuân thủ một điều kiện số học.

- Bản chất toán học: Logic nhị phân

Ở tầng sâu hơn, tự động hóa If–Then là biểu hiện của logic nhị phân:

Đúng (True) → thực hiện

Sai (False) → bỏ qua

Toàn bộ thế giới phức tạp được “nén” thành những câu hỏi dạng:

Điều kiện này có đúng không?

Nếu có → hành động

Nếu không → không hành động

Không có vùng xám.

Không có “có lẽ”.

- Giới hạn lớn: Không linh hoạt

Sức mạnh của tự động hóa cũng chính là điểm yếu của nó.

Vì nó:

Không học từ dữ liệu

Không thích nghi với tình huống mới

Không xử lý tốt ngoại lệ

Ví dụ:

Độ ẩm thấp nhưng vừa mưa xong → vẫn tưới (sai)

Cảm biến lỗi → hệ thống phản ứng sai hoàn toàn

Hệ thống không biết nó đang sai.

Nó chỉ biết nó đang đúng với quy tắc đã được lập trình.

- Ảo giác “thông minh”

Một điều thú vị là:

👉 Khi một hệ thống If–Then đủ phức tạp, con người bắt đầu nghĩ nó “có trí tuệ”.

Ví dụ:

Máy bán hàng tự động

Hệ thống đèn giao thông

Quy trình xử lý đơn hàng

Nhưng thực chất:

Đó chỉ là hàng ngàn quy tắc If–Then ghép lại với nhau.

Không có suy nghĩ.

Không có nhận thức.

Chỉ có:

“Nếu cái này xảy ra → làm cái kia.”

- So sánh ngắn: Tự động hóa vs AI

| Đặc điểm | Tự động hóa If–Then | AI hiện đại |

| Nguồn logic | Con người viết | Học từ dữ liệu |

| Tính dự báo | Tuyệt đối | Xác suất |

| Linh hoạt | Thấp | Cao hơn |

| Bản chất | Quy tắc | Mô hình toán học |

Điều này giúp ta thấy rõ:

👉 Tự động hóa không phải là trí tuệ, mà là kỷ luật của quy trình.

- Ý nghĩa sâu xa

Tự động hóa If–Then cho chúng ta một bài học rất rõ ràng:

Máy móc giỏi nhất khi làm những việc lặp lại

Con người cần thiết nhất khi đối mặt với sự không chắc chắn

Một hệ thống tự động hóa hoàn hảo không phải là hệ thống “thông minh”, mà là hệ thống:

Được thiết kế rõ ràng

Có quy tắc chính xác

Hoạt động nhất quán

- Kết luận

Bản chất của tự động hóa không nằm ở sự kỳ diệu, mà nằm ở sự đơn giản tuyệt đối:

Nếu điều này xảy ra → thì làm điều kia.

Không hơn. Không kém.

Và chính sự đơn giản đó lại tạo nên sức mạnh khổng lồ:

Nó giúp thế giới vận hành trơn tru

Nó giảm sai sót của con người

Nó biến những quy trình phức tạp thành chuỗi hành động có thể kiểm soát

Nhưng đồng thời, nó cũng nhắc nhở chúng ta một điều quan trọng:

👉 Máy có thể làm thay chúng ta, nhưng không thể hiểu thay chúng ta.

Tự động hóa là một công cụ vĩ đại.

Nhưng trí tuệ – vẫn là câu chuyện của con người.

2.2. TRÍ TUỆ NHÂN TẠO (AI): SỰ CHUYỂN DỊCH SANG “DỮ LIỆU – KẾT QUẢ”

Trong lịch sử phát triển của công nghệ, có một bước ngoặt âm thầm nhưng mang tính cách mạng: sự chuyển dịch từ tư duy “quy tắc” sang tư duy “dữ liệu”. Nếu như tự động hóa truyền thống là một thế giới nơi con người đóng vai trò “người ra lệnh tuyệt đối”, thì trí tuệ nhân tạo (AI), đặc biệt là Machine Learning, lại mở ra một cách tiếp cận hoàn toàn khác: con người không còn trực tiếp viết ra mọi logic, mà trao cho máy khả năng tự tìm ra logic đó từ dữ liệu.

Đây không chỉ là một thay đổi về kỹ thuật. Nó là một thay đổi về triết lý nhận thức.

- TỪ “RA LỆNH” ĐẾN “HUẤN LUYỆN”

Trong mô hình truyền thống, máy tính giống như một người học việc cực kỳ chăm chỉ nhưng hoàn toàn thụ động. Bạn muốn nó làm gì, bạn phải nói chính xác từng bước:

Nếu A xảy ra → làm B

Nếu C xảy ra → làm D

Mọi khả năng đều phải được dự đoán trước. Nếu tình huống nằm ngoài danh sách đã định nghĩa, hệ thống sẽ “đứng hình” hoặc xử lý sai.

Nhưng AI thì khác.

AI không bắt đầu bằng các câu lệnh. Nó bắt đầu bằng dữ liệu.

Con người không còn nói:

“Đây là cách để nhận diện một con mèo.”

Thay vào đó, con người nói:

“Đây là hàng triệu ví dụ về mèo và không phải mèo. Hãy tự tìm hiểu.”

Điều này đánh dấu sự chuyển đổi từ lập trình (programming) sang huấn luyện (training).

Lập trình: Viết ra quy tắc

Huấn luyện: Cung cấp trải nghiệm

Máy không còn là người thực thi, mà trở thành một “người học”.

- NGUYÊN LÝ CỐT LÕI: DỮ LIỆU + MỤC TIÊU → LOGIC

Trái tim của AI nằm ở nguyên lý đơn giản nhưng sâu sắc:

Con người cung cấp dữ liệu và mục tiêu → Máy tự xây dựng logic

Ở đây có ba thành phần:

(1) Dữ liệu (Data)

Đây là “kinh nghiệm sống” của AI. Càng nhiều, càng đa dạng, càng tốt. Dữ liệu không chỉ là số, mà có thể là hình ảnh, âm thanh, văn bản, hành vi…

(2) Mục tiêu (Objective / Loss Function)

Máy cần biết thế nào là “đúng” và “sai”. Ví dụ:

Phân loại đúng ảnh mèo → tốt

Nhận nhầm chó thành mèo → sai

Mục tiêu đóng vai trò như “la bàn”.

(3) Quá trình học (Training Process)

Máy thử – sai – điều chỉnh hàng triệu lần. Qua thời gian, nó dần xây dựng một hệ thống logic nội tại cực kỳ phức tạp, thường vượt xa khả năng diễn đạt của con người.

Điều đáng chú ý là:

Logic này không được viết ra bằng lời. Nó được “mã hóa” trong hàng triệu (hoặc hàng tỷ) tham số toán học.

- ĐẶC ĐIỂM NỔI BẬT: KHẢ NĂNG THÍCH NGHI VÀ KHÁI QUÁT HÓA

Một trong những sức mạnh lớn nhất của AI là khả năng:

Thích nghi (Adaptation)

Khái quát hóa (Generalization)

Điều này có nghĩa là AI không chỉ “học thuộc lòng” dữ liệu, mà còn có thể áp dụng những gì đã học vào tình huống mới.

Ví dụ:

Một mô hình được huấn luyện bằng ảnh mèo trong nhà vẫn có thể nhận ra một con mèo ngoài đường, dù ánh sáng, góc chụp, hay màu sắc hoàn toàn khác.

Tại sao?

Bởi vì AI không học các quy tắc đơn giản như:

“Tai nhọn = mèo”

Thay vào đó, nó học những mẫu hình trừu tượng:

Cấu trúc khuôn mặt

Tỷ lệ cơ thể

Texture lông

Hành vi thị giác phức hợp

Những thứ này quá tinh vi để con người viết thành quy tắc, nhưng lại có thể “nổi lên” từ dữ liệu.

- VÍ DỤ KINH ĐIỂN: NHẬN DIỆN HÌNH ẢNH

Hãy so sánh hai cách tiếp cận:

Cách 1: Lập trình truyền thống

Nếu có tai nhọn → có thể là mèo

Nếu có ria → có thể là mèo

Nếu có đuôi dài → có thể là mèo

Vấn đề:

Tai nhọn cũng có ở cáo

Không phải mèo nào cũng rõ ria

Ảnh có thể bị che khuất, mờ, hoặc biến dạng

Hệ thống nhanh chóng trở nên phức tạp và vẫn không đáng tin cậy.

Cách 2: Machine Learning

Nạp 1 triệu ảnh mèo

Nạp 1 triệu ảnh không phải mèo

Cho mô hình tự học

Kết quả:

AI tự khám phá ra những đặc trưng mà con người không thể mô tả rõ ràng

Độ chính xác cao hơn

Khả năng thích nghi tốt hơn

Điều kỳ lạ là:

Ngay cả người tạo ra mô hình cũng không hoàn toàn hiểu nó “nghĩ” như thế nào.

- “HỘP ĐEN” – CÁI GIÁ CỦA SỨC MẠNH

Khi logic không còn được viết bằng ngôn ngữ con người, mà được mã hóa trong các tham số toán học, một vấn đề xuất hiện:

AI trở thành một “hộp đen” (Black Box)

Bạn biết:

Đầu vào là gì

Đầu ra là gì

Nhưng bạn không biết chính xác:

Tại sao nó đưa ra quyết định đó

Điều này dẫn đến những câu hỏi lớn:

Có thể tin AI trong y tế không?

Nếu AI sai, ai chịu trách nhiệm?

Làm sao kiểm tra tính công bằng?

Sức mạnh càng lớn, nhu cầu minh bạch càng cao.

- DỮ LIỆU – “THỨC ĂN” QUYẾT ĐỊNH TRÍ TUỆ

Một sự thật quan trọng:

AI không thông minh hơn dữ liệu mà nó được học.

Nếu dữ liệu:

Thiên lệch → AI cũng thiên lệch

Thiếu đa dạng → AI kém linh hoạt

Sai → AI học sai

Ví dụ:

Nếu mô hình nhận diện khuôn mặt chỉ được huấn luyện trên một nhóm người nhất định, nó sẽ hoạt động kém với các nhóm khác.

Do đó, trong thế giới AI:

Dữ liệu không chỉ là tài nguyên

Nó là nền tảng đạo đức và chất lượng

- SỰ THAY ĐỔI VAI TRÒ CỦA CON NGƯỜI

Trong kỷ nguyên “Nếu – Thì”, con người là:

Người viết luật

Người kiểm soát tuyệt đối

Trong kỷ nguyên “Dữ liệu – Kết quả”, con người trở thành:

Người chọn dữ liệu

Người định nghĩa mục tiêu

Người giám sát quá trình học

Nói cách khác, con người không còn “dạy từng bước”, mà “định hướng cách học”.

Điều này đòi hỏi một kỹ năng mới:

Không phải chỉ biết lập trình

Mà phải hiểu dữ liệu, thống kê, và hành vi hệ thống

- GIỚI HẠN CỦA AI: KHÔNG PHẢI “HIỂU BIẾT”

Dù có khả năng học từ dữ liệu, AI vẫn không:

Có ý thức

Có trải nghiệm

Có sự hiểu biết theo nghĩa con người

Nó không “biết” con mèo là gì.

Nó chỉ biết xác suất rằng một hình ảnh giống với những gì nó từng thấy.

Sự khác biệt này rất quan trọng:

Con người hiểu → gắn với ý nghĩa

AI dự đoán → gắn với xác suất

- TƯƠNG LAI: KHI DỮ LIỆU TRỞ THÀNH NGÔN NGỮ MỚI

Chúng ta đang bước vào một thời đại nơi:

Dữ liệu trở thành “nguyên liệu thô” của trí tuệ

Mô hình trở thành “công cụ chế biến”

Kết quả trở thành “sản phẩm”

Những tổ chức mạnh không chỉ là những tổ chức có công nghệ tốt, mà là những tổ chức:

Có dữ liệu tốt

Biết khai thác dữ liệu

Hiểu giới hạn của dữ liệu

KẾT LUẬN

Sự chuyển dịch từ “Nếu – Thì” sang “Dữ liệu – Kết quả” không chỉ là một bước tiến kỹ thuật. Nó là một cuộc cách mạng trong cách con người tiếp cận tri thức và hành động.

AI không thay thế hoàn toàn vai trò của con người, nhưng nó thay đổi cách chúng ta:

Giải quyết vấn đề

Ra quyết định

Hiểu về trí tuệ

Thông điệp cốt lõi là:

AI không phải là một cỗ máy biết suy nghĩ.

Nó là một hệ thống biết học từ dữ liệu.

Và trong thế giới đó, câu hỏi quan trọng nhất không còn là:

“Ta nên viết quy tắc gì?”

Mà là:

“Ta đang cho máy học từ dữ liệu nào?”

2.3. BA CẤP ĐỘ CỦA SỰ THÔNG MINH – NHÌN XUYÊN QUA LỚP VỎ “AI”

Trong thời đại mà mọi thiết bị đều được gắn mác “thông minh”, việc phân biệt đâu là trí tuệ thực sự và đâu chỉ là sự tinh vi của kỹ thuật trở nên quan trọng hơn bao giờ hết. Không phải cứ có điện, có chip, có phần mềm là có “trí tuệ”. Để hiểu đúng, chúng ta cần bóc tách công nghệ thành ba cấp độ – giống như ba tầng của một tòa nhà: từ nền móng cơ học, đến hệ thống phản xạ, và cuối cùng mới chạm đến thứ gần với “học hỏi”.

- CẤP ĐỘ 1: QUY TRÌNH CỨNG (HARD-CODED) – NHỮNG CỖ MÁY KHÔNG BAO GIỜ “HIỂU”

Đây là tầng thấp nhất, nhưng cũng là nền tảng của toàn bộ thế giới công nghệ.

Một thuật toán sắp xếp danh sách, một công thức trong Excel, hay một chương trình tính lương – tất cả đều hoạt động theo nguyên tắc đơn giản:

Con người viết luật → Máy thực hiện chính xác 100%

Không có sự linh hoạt. Không có học hỏi. Không có bất kỳ “ý định” nào.

Nếu bạn viết:

“Nếu A > B thì đổi chỗ”

“Nếu doanh thu > 1 tỷ thì thưởng 10%”

… thì máy sẽ làm đúng như vậy, trong mọi trường hợp, không bao giờ hỏi lại:

“Liệu quy tắc này còn phù hợp không?”

“Có trường hợp ngoại lệ nào không?”

Ở cấp độ này, máy giống như một người công nhân hoàn hảo nhưng mù quáng. Nó không sai – nhưng cũng không biết mình đang làm gì.

Điểm mạnh:

Chính xác tuyệt đối

Dự đoán được

Kiểm soát hoàn toàn

Điểm yếu:

Không thích nghi

Không xử lý được tình huống mới

Phụ thuộc hoàn toàn vào con người

👉 Vì vậy, gọi những hệ thống này là “AI” là một sự phóng đại. Chúng chỉ là logic được đóng băng.

- CẤP ĐỘ 2: TỰ ĐỘNG HÓA THÍCH NGHI (ADAPTIVE AUTOMATION) – PHẢN XẠ NHƯNG CHƯA PHẢI TRÍ TUỆ

Ở tầng thứ hai, mọi thứ bắt đầu “trông có vẻ thông minh hơn”.

Hãy nghĩ đến:

Máy điều hòa inverter tự điều chỉnh công suất

Xe hơi có cảm biến lùi

Hệ thống tưới nước tự động theo độ ẩm đất

Điện thoại tự điều chỉnh độ sáng màn hình

Những hệ thống này không còn chỉ làm theo một lệnh cố định. Chúng có khả năng:

Nhận tín hiệu từ môi trường (sensor)

So sánh với ngưỡng đã định

Điều chỉnh hành vi

Cơ chế cơ bản vẫn là:

Nếu (tín hiệu A) → thì (hành động B)

Nhưng A không còn là dữ liệu tĩnh, mà là dữ liệu từ thế giới thực.

Ví dụ:

Nếu nhiệt độ phòng > 28°C → tăng công suất làm lạnh

Nếu ánh sáng yếu → tăng độ sáng màn hình

Điều này tạo ra ảo giác rằng máy “hiểu” môi trường. Nhưng thực ra:

Nó không hiểu “nóng” là gì

Nó không biết “thoải mái” là gì

Nó chỉ phản ứng với con số

Nói cách khác, đây là phản xạ có điều kiện, giống như:

Con chó nghe chuông thì chảy nước miếng (thí nghiệm Pavlov)

Con người rụt tay lại khi chạm vào vật nóng

👉 Có phản ứng, nhưng chưa có nhận thức.

Điểm mạnh:

Linh hoạt hơn cấp độ 1

Tối ưu hiệu suất theo môi trường

Giảm nhu cầu can thiệp của con người

Điểm yếu:

Vẫn bị giới hạn bởi quy tắc do con người đặt ra

Không tự tạo ra quy luật mới

Không học từ kinh nghiệm quá khứ theo nghĩa thực sự

👉 Đây là nơi marketing thường “đánh tráo khái niệm”. Rất nhiều sản phẩm được gọi là “AI” thực chất chỉ nằm ở cấp độ này.

- CẤP ĐỘ 3: HỌC MÁY THỰC THỤ (TRUE MACHINE LEARNING) – BƯỚC KHỞI ĐẦU CỦA AI

Chỉ đến tầng thứ ba, chúng ta mới thực sự bước vào lãnh địa của trí tuệ nhân tạo.

Sự khác biệt cốt lõi nằm ở một điểm:

Máy không còn được dạy “luật” → mà tự tìm ra “luật” từ dữ liệu

Thay vì viết:

“Nếu email chứa từ ‘trúng thưởng’ thì là spam”

Chúng ta đưa cho máy:

Hàng triệu email (có nhãn spam / không spam)

Và máy sẽ:

Phân tích

Tìm mẫu (pattern)

Tự xây dựng mô hình dự đoán

Đây là lúc các khái niệm như:

Xác suất

Thống kê

Tối ưu hóa

Không gian vector

… trở thành “ngôn ngữ” của hệ thống.

Một mô hình học máy không nói:

“Đây là đáp án đúng”

Nó nói:

“Khả năng cao nhất là đáp án này”

Ví dụ:

“Ô” → 85%

“Áo mưa” → 12%

👉 Và nó chọn phương án có xác suất cao nhất.

Điều quan trọng:

Nó có thể sai

Nhưng nó có thể học để sai ít hơn theo thời gian

Đây chính là sự khác biệt giữa:

Một cỗ máy “thực hiện”

Và một hệ thống “cải thiện”

Điểm mạnh:

Xử lý được dữ liệu phức tạp

Thích nghi với tình huống mới

Hiệu suất tăng theo dữ liệu

Điểm yếu:

Không minh bạch (black box)

Phụ thuộc dữ liệu

Có thể học sai nếu dữ liệu sai

👉 Đây là nơi bắt đầu của cái mà chúng ta gọi là “AI”. Nhưng cần nhấn mạnh:

Nó không “hiểu” theo nghĩa con người.

Nó chỉ tối ưu hóa dự đoán.

SỰ NHẦM LẪN LỚN NHẤT: ĐÁNH ĐỒNG CẢ BA CẤP ĐỘ

Một chiếc máy giặt:

Tự cân nước → cấp độ 2

Một bảng Excel:

Tính toán tự động → cấp độ 1

Một hệ thống nhận diện khuôn mặt:

Học từ hàng triệu hình ảnh → cấp độ 3

👉 Nhưng tất cả đều bị gọi chung là “AI”.

Đây không chỉ là sai về mặt kỹ thuật – mà còn nguy hiểm về nhận thức.

Khi chúng ta:

Thổi phồng cấp độ 2 thành “trí tuệ”

Và hiểu sai cấp độ 3 là “ý thức”

… chúng ta bắt đầu:

Tin vào những điều không có thật

Sợ hãi những điều không tồn tại

Trao quyền cho những hệ thống mà mình không hiểu

KẾT LUẬN: TRÍ TUỆ KHÔNG NẰM Ở MÁY – MÀ NẰM Ở CÁCH TA HIỂU MÁY

Ba cấp độ này không chỉ là phân loại kỹ thuật. Nó là một “bản đồ nhận thức” giúp chúng ta:

Không bị đánh lừa bởi ngôn từ marketing

Không thần thánh hóa công nghệ

Không hạ thấp vai trò của con người

Cấp độ 1 cho ta sự chính xác

Cấp độ 2 cho ta sự tiện lợi

Cấp độ 3 cho ta khả năng dự đoán

Nhưng không cấp độ nào cho ta:

Ý thức

Trực giác

Đạo đức

Ý nghĩa

Những điều đó vẫn – và có lẽ luôn luôn – thuộc về con người.

Thông điệp cốt lõi:

AI không phải là một thực thể “thông minh” theo nghĩa con người.

Nó là một hệ thống toán học biết tối ưu hóa dự đoán từ dữ liệu.

Và hiểu được ba cấp độ này

chính là bước đầu tiên để không bị “ảo tưởng về trí tuệ của máy”.

2.4. Tại sao sự nhầm lẫn giữa “AI” và “tự động hóa” lại nguy hiểm?

Trong kỷ nguyên số, “AI” đã trở thành một từ khóa đầy sức hút – gần như là một biểu tượng của tiến bộ, trí tuệ và tương lai. Nhưng chính vì sức hấp dẫn đó, nó bị kéo ra khỏi ý nghĩa kỹ thuật ban đầu và bị sử dụng một cách bừa bãi. Khi mọi hệ thống có chút “thông minh bề mặt” đều được gọi là AI, ranh giới giữa tự động hóa và trí tuệ nhân tạo thực sự bị xóa nhòa. Và sự nhầm lẫn này không chỉ là vấn đề ngôn ngữ – nó tạo ra những hệ quả rất thực tế, ảnh hưởng đến cách con người suy nghĩ, quyết định và hành động.

- Khi kỳ vọng vượt quá thực tế: Ảo tưởng về năng lực của máy móc

Một trong những hậu quả rõ ràng nhất của sự nhầm lẫn là kỳ vọng quá mức.

Khi một hệ thống tự động đơn giản – ví dụ như chatbot trả lời theo kịch bản có sẵn, hay một phần mềm gửi email theo lịch – được quảng bá là “AI”, người dùng dễ dàng tin rằng nó có khả năng:

Hiểu ngữ cảnh sâu sắc

Sáng tạo giải pháp mới

Thích nghi linh hoạt như con người

Nhưng thực tế, những hệ thống này chỉ làm đúng những gì chúng được lập trình. Chúng không “hiểu”, không “suy nghĩ”, và càng không “sáng tạo”.

Hệ quả nguy hiểm nằm ở chỗ:

Con người bắt đầu giao phó những nhiệm vụ phức tạp cho những công cụ không đủ năng lực.

Ví dụ:

Doanh nghiệp tin rằng một chatbot “AI” có thể thay thế hoàn toàn chăm sóc khách hàng → dẫn đến trải nghiệm tệ hại.

Người quản lý dựa vào các hệ thống phân tích dữ liệu đơn giản để đưa ra quyết định chiến lược → dẫn đến sai lầm lớn.

Ở đây, vấn đề không phải là công nghệ kém, mà là kỳ vọng sai. Khi bạn nghĩ mình đang sử dụng một “bộ não”, nhưng thực ra chỉ là một “cỗ máy phản xạ”, bạn đang tự đặt mình vào rủi ro.

- Khi nỗi sợ vượt khỏi thực tế: Huyền thoại về “AI nổi loạn”

Ở thái cực ngược lại là nỗi sợ vô căn cứ.

Khi mọi thứ đều bị gán nhãn AI, con người bắt đầu tưởng tượng rằng:

Máy giặt “thông minh” có thể học cách chống lại chủ nhân

Thuật toán đề xuất video có thể “thao túng tâm trí” theo ý riêng

Các hệ thống tự động đơn giản có thể phát triển ý thức

Những nỗi sợ này phần lớn bắt nguồn từ việc nhân cách hóa máy móc – một xu hướng tâm lý rất tự nhiên của con người.

Nhưng cần nói rõ:

Một thuật toán không có mục đích riêng

Một mô hình không có ý chí

Một hệ thống không có “ham muốn tồn tại”

Ngay cả những hệ thống AI tiên tiến nhất hiện nay cũng chỉ:

Xử lý dữ liệu

Tối ưu hóa xác suất

Tạo ra đầu ra dựa trên mẫu đã học

Chúng không có “cái tôi” để mà nổi loạn.

Nguy hiểm của nỗi sợ này là gì?

Nó làm chậm sự phát triển công nghệ do phản ứng thái quá

Nó khiến xã hội đưa ra các quyết định chính sách dựa trên cảm xúc thay vì hiểu biết

Nó làm lệch hướng các cuộc thảo luận đạo đức thực sự (như quyền riêng tư, thiên vị dữ liệu)

- Sự nhầm lẫn làm mờ đi ranh giới trách nhiệm

Một hệ quả tinh vi hơn nhưng cực kỳ quan trọng:

Sự nhầm lẫn làm chúng ta không biết phải quy trách nhiệm cho ai.

Khi một hệ thống được gọi là “AI”, người ta dễ nói:

“AI đã quyết định như vậy.”

Nhưng thực tế:

Con người thiết kế thuật toán

Con người chọn dữ liệu

Con người đặt mục tiêu tối ưu

Nếu một hệ thống đưa ra quyết định sai lệch (ví dụ: thiên vị trong tuyển dụng, sai sót trong chẩn đoán), thì:

Đó không phải là “AI tự ý sai”

Mà là hệ quả của thiết kế và dữ liệu

Khi chúng ta thần bí hóa AI, chúng ta vô tình:

Giảm trách nhiệm của con người

Tạo ra một “lá chắn” vô hình cho những sai lầm kỹ thuật

- Làm lệch hướng đầu tư và chiến lược phát triển

Trong doanh nghiệp và tổ chức, việc hiểu sai AI dẫn đến:

Đầu tư sai chỗ (mua “AI” thay vì cải thiện quy trình)

Bỏ qua những giải pháp đơn giản nhưng hiệu quả

Theo đuổi “hào quang công nghệ” thay vì giá trị thực

Một công ty có thể:

Chi hàng triệu đô cho “AI transformation”

Nhưng lại không có dữ liệu sạch hoặc quy trình rõ ràng

Kết quả là:

Một hệ thống phức tạp chạy trên nền tảng hỗn loạn.

Trong khi đó, đôi khi:

Một hệ thống tự động hóa tốt (RPA, workflow rõ ràng)

Lại mang lại hiệu quả cao hơn nhiều

- Hiểu sai về bản chất của trí tuệ

Ở tầng sâu hơn, sự nhầm lẫn này làm méo mó cách chúng ta hiểu về trí tuệ.

Khi một hệ thống trả lời lưu loát, chúng ta dễ nghĩ:

“Nó hiểu.”

Nhưng thực tế:

Nó chỉ dự đoán chuỗi ký tự có xác suất cao nhất

Nó không có trải nghiệm, không có ý thức

Nếu không phân biệt rõ:

Chúng ta có thể đánh giá thấp trí tuệ con người

Hoặc đánh giá quá cao khả năng của máy

Cả hai đều nguy hiểm.

- Thông điệp cốt lõi: Hai loại “lặp lại” khác nhau

Điểm mấu chốt của toàn bộ vấn đề nằm ở sự phân biệt rất quan trọng:

Tự động hóa: xử lý sự lặp lại của hành động

→ Làm thay con người những việc tay chân, quy trình cố định

AI (Machine Learning): xử lý sự lặp lại của nhận thức

→ Hỗ trợ con người trong việc nhận diện mẫu, dự đoán, phân tích

Nhưng ngay cả AI:

Cũng không “hiểu” theo nghĩa con người

Chỉ là một hệ thống toán học cực kỳ tinh vi

Vì vậy:

Một hệ thống, dù phức tạp đến đâu, nếu không có khả năng tự điều chỉnh hành vi dựa trên dữ liệu mới, thì vẫn chỉ là một cỗ máy tự động – không hơn, không kém.

- Kết luận: Sự rõ ràng là nền tảng của trí tuệ

Sự nguy hiểm không nằm ở bản thân công nghệ, mà nằm ở cách chúng ta hiểu và sử dụng nó.

Gọi đúng tên → giúp đặt đúng kỳ vọng

Hiểu đúng bản chất → giúp sử dụng đúng cách

Phân biệt rõ ràng → giúp tránh cả ảo tưởng lẫn hoảng loạn

Trong một thế giới mà “AI” trở thành khẩu hiệu marketing,

việc giữ được sự tỉnh táo không chỉ là lợi thế – mà là trách nhiệm trí tuệ.

Tóm lại:

Đừng thần thánh hóa tự động hóa

Đừng sợ hãi AI một cách mù quáng

Và quan trọng nhất:

Hãy nhìn công nghệ như nó vốn là – không hơn, không kém.

CHƯƠNG 3: “HỘP ĐEN” VÀ GIỚI HẠN CỦA SỰ MINH BẠCH

Nếu ở những phần trước, chúng ta đã gỡ bỏ lớp hào quang huyền bí của AI — từ một “thực thể thông minh” xuống đúng bản chất của nó là một hệ thống toán học phức tạp — thì đến đây, nghịch lý lớn nhất bắt đầu lộ diện:

Chúng ta tạo ra AI, nhưng không hoàn toàn hiểu nó.

Nghe có vẻ vô lý. Làm sao con người có thể xây dựng một thứ mà chính mình lại không nắm rõ cách nó vận hành? Nhưng đó chính là bản chất của hiện tượng được gọi là “Hộp đen” (Black Box) trong trí tuệ nhân tạo hiện đại.

- “Hộp đen” là gì – và tại sao nó tồn tại?

Trong khoa học và kỹ thuật, một hệ thống được gọi là “hộp đen” khi:

Bạn biết đầu vào (input)

Bạn quan sát được đầu ra (output)

Nhưng bạn không thể giải thích rõ ràng quá trình bên trong

AI hiện đại — đặc biệt là các mô hình học sâu (Deep Learning) — chính là một hộp đen như vậy.

Hãy tưởng tượng:

Bạn đưa vào một bức ảnh → AI trả lời: “Đây là một con mèo”

Bạn đưa vào một đoạn văn → AI tóm tắt nội dung

Bạn đưa vào dữ liệu y tế → AI dự đoán nguy cơ bệnh

Nhưng câu hỏi quan trọng là:

Tại sao nó lại đưa ra kết luận đó?

Không phải theo kiểu “vì quy tắc A, B, C”…

Mà là: chuỗi quyết định nội tại của nó là gì?

Câu trả lời thường là:

👉 Không ai có thể giải thích đầy đủ ở mức chi tiết.

- Sự phức tạp vượt khỏi khả năng diễn giải

Một mô hình AI hiện đại có thể chứa:

Hàng triệu → hàng tỷ tham số

Hàng trăm lớp tính toán

Các tương tác phi tuyến cực kỳ phức tạp

Những con số này không chỉ lớn — chúng vượt quá khả năng trực giác của con người.

Trước đây, với lập trình truyền thống:

Con người viết từng dòng logic

Có thể truy vết: “Nếu A → thì B → nên C”

Nhưng với AI:

Con người không viết quy tắc

Con người chỉ đặt cấu trúc và cho dữ liệu

Chính hệ thống tự điều chỉnh các tham số

Kết quả là:

Logic không còn được “viết ra”

mà được “hình thành” bên trong một không gian toán học khổng lồ

Và không gian đó… không dễ đọc như ngôn ngữ con người

- Một nghịch lý đáng suy nghĩ

Điều này dẫn đến một nghịch lý rất đặc biệt:

AI càng mạnh → con người càng ít hiểu rõ nó

Vì:

Mô hình càng đơn giản → dễ giải thích nhưng kém hiệu quả

Mô hình càng phức tạp → hiệu quả cao nhưng khó hiểu

Đây là sự đánh đổi giữa:

Hiệu suất (Performance)

Tính minh bạch (Interpretability)

Trong nhiều trường hợp, để đạt được độ chính xác cao, chúng ta buộc phải chấp nhận:

👉 mất đi khả năng giải thích rõ ràng

- Nguy cơ của “Hộp đen”

Hiện tượng này không chỉ là vấn đề kỹ thuật — nó là một vấn đề đạo đức và xã hội sâu sắc.

- Quyết định không thể giải thích

Hãy tưởng tượng:

Một AI từ chối khoản vay của bạn

Một AI chẩn đoán bạn mắc bệnh

Một AI quyết định bạn có được nhận việc hay không

Bạn hỏi:

“Tại sao?”

Và câu trả lời là:

👉 “Hệ thống đã tính toán như vậy”

Đây là một câu trả lời… không thể chấp nhận trong nhiều lĩnh vực.

- Thiên lệch ẩn (Hidden Bias)

AI học từ dữ liệu.

Nếu dữ liệu có thiên lệch, AI sẽ khuếch đại thiên lệch đó.

Nhưng vì là “hộp đen”, nên:

Thiên lệch không lộ rõ

Rất khó phát hiện

Càng khó sửa chữa

Điều này có thể dẫn đến:

Phân biệt đối xử

Sai lệch trong y tế

Bất công trong hệ thống pháp lý

- Ảo tưởng về sự khách quan

Con người có xu hướng tin rằng:

“Máy móc thì khách quan”

Nhưng thực tế:

AI không có ý thức

Không có đạo đức

Không có trách nhiệm

Nó chỉ phản ánh dữ liệu — mà dữ liệu thì do con người tạo ra.

👉 Vì vậy, “khách quan” của AI đôi khi chỉ là

định kiến được che giấu dưới lớp toán học

- Nỗ lực “mở hộp đen”

Trước nguy cơ này, một lĩnh vực đã ra đời:

👉 Explainable AI (XAI) – AI có thể giải thích

Mục tiêu là:

Hiểu được vì sao AI đưa ra quyết định

Làm cho mô hình “minh bạch hơn”

Giúp con người kiểm soát tốt hơn

Một số phương pháp:

Phân tích mức độ ảnh hưởng của từng yếu tố đầu vào

Xây dựng mô hình đơn giản hơn để “diễn giải” mô hình phức tạp

Trực quan hóa cách AI “nhìn” dữ liệu

Tuy nhiên, cần thẳng thắn:

Chúng ta không thực sự “mở hộp đen”

mà chỉ đang soi đèn pin vào bên trong

- Giới hạn không thể tránh?

Có một câu hỏi lớn:

👉 Liệu chúng ta có thể hoàn toàn hiểu AI không?

Câu trả lời trung thực là:

Có thể không bao giờ hoàn toàn.

Vì:

Hệ thống quá phức tạp

Hành vi emergent (phát sinh) không thể dự đoán trước

Không gian toán học vượt khỏi khả năng trực giác

Điều này đặt con người vào một vị trí rất lạ:

Người sáng tạo… nhưng không phải là người thấu hiểu hoàn toàn

- Bài học quan trọng

Từ “Hộp đen”, chúng ta rút ra một nguyên tắc cốt lõi:

❗ Đừng nhầm lẫn giữa:

Khả năng tạo ra kết quả

và

Sự hiểu biết thực sự

AI có thể:

Dự đoán

Tối ưu

Phân loại

Nhưng:

👉 Nó không “hiểu” theo cách con người hiểu

👉 Và chúng ta cũng không hoàn toàn hiểu nó

- Vai trò không thể thay thế của con người

Chính vì vậy, vai trò của con người không hề giảm đi — mà còn trở nên quan trọng hơn:

Con người đặt câu hỏi: “Có nên dùng AI ở đây không?”

Con người chịu trách nhiệm cuối cùng

Con người kiểm soát đạo đức và giá trị

AI có thể đưa ra gợi ý, nhưng:

Quyết định cuối cùng phải thuộc về một chủ thể có ý thức

- Kết luận: Khi sự khiêm tốn trở thành cần thiết

“Hộp đen” không chỉ là một vấn đề kỹ thuật.

Nó là một lời nhắc nhở mang tính triết học:

Về giới hạn của tri thức con người

Về sự nguy hiểm của niềm tin mù quáng vào công nghệ

Về sự cần thiết của trách nhiệm và khiêm tốn

Chúng ta đã không tạo ra một “vị thần”.

Nhưng chúng ta cũng không tạo ra một công cụ hoàn toàn trong tầm kiểm soát.

AI nằm ở giữa:

Một cỗ máy cực kỳ mạnh

nhưng không hoàn toàn minh bạch

và không bao giờ nên được tin tưởng tuyệt đối

Thông điệp cốt lõi của chương này:

AI không chỉ không hiểu chúng ta —

mà đôi khi, chính chúng ta cũng không hiểu AI.

3.1. Nghịch lý của sự thông minh: Càng giỏi càng khó hiểu

Nghịch lý của sự thông minh: Càng giỏi càng khó hiểu

Trong lịch sử phát triển công nghệ, con người luôn bị ám ảnh bởi một lý tưởng: không chỉ tạo ra những hệ thống hoạt động tốt, mà còn phải hiểu được chúng. Minh bạch không chỉ là một tiêu chí kỹ thuật; nó là nền tảng của niềm tin. Khi một chương trình máy tính thực hiện sai phép tính, lập trình viên có thể truy vết từng bước, từng dòng lệnh, từng điều kiện “nếu – thì” để tìm ra nguyên nhân. Đó là một thế giới tuyến tính, nơi logic giống như một con đường thẳng: rõ ràng, có thể đọc, có thể giải thích.

Nhưng khi chúng ta bước vào kỷ nguyên của AI hiện đại, đặc biệt là các mạng thần kinh nhân tạo, lý tưởng này bắt đầu rạn nứt.

- Từ “công cụ minh bạch” đến “hộp đen hiệu quả”

Trong lập trình truyền thống, một hệ thống giống như một cuốn sách hướng dẫn:

Bạn viết ra quy tắc.

Máy làm theo quy tắc.

Nếu sai, bạn sửa quy tắc.

Mối quan hệ nhân – quả rõ ràng: đầu vào → xử lý → đầu ra.

Nhưng với AI, đặc biệt là Deep Learning, chúng ta không còn viết quy tắc nữa. Thay vào đó:

Chúng ta đưa dữ liệu vào.

Hệ thống tự điều chỉnh hàng triệu, thậm chí hàng tỷ tham số.

Kết quả xuất hiện như một “suy đoán” được tối ưu hóa.

Điều này tạo ra một sự đảo chiều căn bản:

Con người không còn lập trình hành vi — mà chỉ thiết kế khả năng học.

- “Mê cung toán học” thay cho “dòng lệnh logic”

Một mạng thần kinh không suy nghĩ theo kiểu “nếu A thì B”. Nó hoạt động như một hệ thống các hàm toán học chồng chéo:

Mỗi “nơ-ron” là một phép biến đổi số học.

Mỗi lớp (layer) là một tầng trừu tượng hóa.

Toàn bộ mạng là một hàm cực kỳ phức tạp trong không gian nhiều chiều.

Khi AI đưa ra một kết quả, điều thực sự xảy ra là:

Dữ liệu đi qua hàng trăm lớp biến đổi.

Mỗi lớp thay đổi biểu diễn của dữ liệu một chút.

Cuối cùng, hệ thống hội tụ về một xác suất cao nhất.

Không có “lý do” theo nghĩa con người hiểu. Chỉ có trọng số và tối ưu hóa.

Nói cách khác:

AI không “lập luận” — nó “tính toán xác suất ở quy mô khổng lồ”.

- Nghịch lý cốt lõi: Hiệu suất tăng → khả năng giải thích giảm

Đây chính là nghịch lý:

Những mô hình đơn giản (hồi quy tuyến tính, cây quyết định nhỏ) → dễ hiểu nhưng kém mạnh.

Những mô hình phức tạp (deep neural networks) → cực kỳ chính xác nhưng gần như không thể giải thích.

Ta có thể hình dung một trục đánh đổi:

| Độ chính xác | Khả năng giải thích |

| Thấp | Cao |

| Cao | Thấp |

Càng tiến về phía “thông minh hơn”, ta càng rời xa “hiểu được”.

Đây không phải là lỗi. Nó là hệ quả tất yếu của độ phức tạp.

- “Hiểu” là gì — và tại sao AI phá vỡ định nghĩa đó?

Khi con người nói “tôi hiểu”, điều đó thường có nghĩa là:

Tôi có thể giải thích bằng ngôn ngữ.

Tôi có thể truy vết nguyên nhân.

Tôi có thể áp dụng logic tương tự cho tình huống khác.

Nhưng AI không vận hành theo ba tiêu chí này.

Một mô hình có thể:

Nhận diện khuôn mặt chính xác hơn con người,

Dịch ngôn ngữ trôi chảy,

Viết văn bản hợp lý,

…nhưng không thể trả lời một cách trung thực câu hỏi:

“Tại sao mày lại chọn kết quả đó?”

Nếu nó “giải thích”, thì thực chất nó đang tạo ra một lời giải thích hợp lý, không phải truy xuất nguyên nhân thực sự.

- Ảo giác về sự hiểu

Đây là điểm nguy hiểm nhất.

Khi AI nói năng trôi chảy, con người có xu hướng:

Gán cho nó ý thức,

Tin rằng nó có lý do,

Nghĩ rằng nó “biết tại sao”.

Nhưng thực tế:

Sự lưu loát không đồng nghĩa với sự hiểu biết.

AI giống như một diễn viên cực kỳ giỏi:

Nó có thể đóng vai một người hiểu sâu sắc,

Nhưng phía sau chỉ là kịch bản xác suất.

- Hệ quả thực tế: Khi “không hiểu” trở thành rủi ro

Nghịch lý này không chỉ là vấn đề triết học. Nó có hậu quả rất cụ thể:

- Trong y tế

Một AI chẩn đoán bệnh chính xác cao, nhưng:

Không giải thích được lý do,

Bác sĩ khó tin tưởng hoàn toàn,

Và khó chịu trách nhiệm nếu sai.

- Trong tài chính

Một hệ thống từ chối khoản vay:

Khách hàng hỏi “tại sao?”

Hệ thống không thể trả lời rõ ràng

→ Vấn đề pháp lý và đạo đức xuất hiện.

- Trong pháp luật

Nếu một thuật toán đề xuất mức án:

Nhưng không ai hiểu cách nó suy luận,

→ Công lý trở thành một “hộp đen”.

- Nỗ lực phá vỡ “hộp đen”

Con người không chấp nhận nghịch lý này một cách thụ động. Một lĩnh vực mới ra đời: Explainable AI (XAI).

Các kỹ thuật như:

SHAP (giải thích đóng góp từng đặc trưng)

LIME (mô hình cục bộ dễ hiểu)

Attention visualization (trực quan hóa sự “chú ý”)

…cố gắng trả lời câu hỏi:

“AI đã nhìn vào đâu để đưa ra quyết định?”

Nhưng cần thẳng thắn:

Đây không phải là “giải thích thật”, mà là “xấp xỉ của sự giải thích”.

Chúng ta không mở hộp đen — chúng ta chỉ chiếu đèn vào một phần của nó.

- Một sự thật khó chấp nhận

Chúng ta đang bước vào một thời đại kỳ lạ:

Chúng ta tạo ra những hệ thống vượt qua khả năng con người trong nhiều nhiệm vụ.

Nhưng chúng ta không thể hiểu đầy đủ cách chúng hoạt động.

Điều này đảo ngược trật tự truyền thống của tri thức:

Trước đây: Hiểu → Làm được

Bây giờ: Làm được → Nhưng không hoàn toàn hiểu

- Kết luận: Thông minh không đồng nghĩa với minh bạch

Nghịch lý “càng giỏi càng khó hiểu” buộc chúng ta phải thay đổi cách nhìn về trí tuệ:

Trí tuệ không còn gắn liền với khả năng giải thích.

Hiệu quả không còn đảm bảo minh bạch.

Và kiểm soát không còn tuyệt đối.

Câu hỏi lớn không còn là:

“AI có thông minh không?”

Mà là:

“Chúng ta có chấp nhận sử dụng những thứ mà mình không hoàn toàn hiểu không?”

Đây không chỉ là câu hỏi kỹ thuật.

Nó là câu hỏi về niềm tin, đạo đức, và tương lai của việc ra quyết định trong xã hội con người.

3.2. Khi “logic” của máy không phải là logic của người

Câu chuyện về hệ thống AI phân biệt chó và mèo nhưng lại “nhìn” vào… góc ảnh chứa cỏ không phải là một giai thoại hiếm hoi trong lĩnh vực Machine Learning. Ngược lại, nó là một ví dụ kinh điển để phơi bày một sự thật sâu sắc: logic của máy không phải là logic của con người, và việc nhầm lẫn hai loại logic này có thể dẫn đến những hiểu lầm nghiêm trọng về bản chất của AI.

- Logic của con người: Dựa trên ý nghĩa và bản chất

Khi con người phân biệt chó và mèo, chúng ta không chỉ “nhìn” – chúng ta hiểu.

Chúng ta sử dụng một hệ thống nhận thức phức tạp bao gồm:

Hình dạng cơ thể (tai, mõm, đuôi)

Hành vi (chó hay vẫy đuôi, mèo thường độc lập hơn)

Ngữ cảnh (chó thường xuất hiện ở công viên, mèo trong nhà… nhưng không phải lúc nào cũng vậy)

Quan trọng hơn, con người có khả năng trừu tượng hóa và loại bỏ yếu tố không liên quan. Nếu thấy một con mèo trên bãi cỏ, chúng ta không kết luận rằng “mọi con vật trên cỏ đều là chó”.

Nói cách khác, logic của con người gắn với:

Nguyên nhân (causation)

Ý nghĩa (semantics)

Hiểu biết về thế giới thực (world model)

- Logic của máy: Tối ưu hóa xác suất, không phải sự thật

Trong khi đó, một mô hình AI – đặc biệt là mạng nơ-ron sâu (Deep Neural Network) – vận hành dựa trên các nguyên lý của Thống kê học và tối ưu hóa toán học.

Nó không hỏi:

“Con vật này là gì?”

Nó chỉ hỏi:

“Tập hợp các pixel này giống với mẫu nào trong dữ liệu huấn luyện nhất?”

Cốt lõi của quá trình này là tìm các mối tương quan – một khái niệm trong Correlation – chứ không phải quan hệ nhân quả.

Vì vậy, nếu trong dữ liệu:

90% ảnh chó có cỏ ở góc dưới

90% ảnh mèo không có

Thì mô hình sẽ học rằng:

“Có cỏ ở góc → khả năng cao là chó”

Dù mối liên hệ này hoàn toàn phi lý về mặt bản chất.

- “Shortcut learning” – Khi AI chọn con đường dễ nhất

Hiện tượng này có một tên gọi trong giới nghiên cứu: shortcut learning (học đường tắt).

AI không “cố gắng hiểu đúng”, mà nó cố gắng đạt kết quả tốt nhất với chi phí thấp nhất. Nếu có một dấu hiệu đơn giản (như cỏ ở góc ảnh) giúp tăng độ chính xác, nó sẽ sử dụng dấu hiệu đó – bất kể nó có hợp lý hay không.

Điều này dẫn đến một nghịch lý:

Mô hình có thể đạt độ chính xác 99%

Nhưng lại hoàn toàn không hiểu bản chất vấn đề

- Hộp đen: Khi chúng ta không biết AI đang “nghĩ” gì

Vấn đề trở nên nghiêm trọng hơn khi các mô hình hiện đại ngày càng phức tạp.

Một mạng nơ-ron sâu có thể chứa:

Hàng triệu đến hàng tỷ tham số

Các lớp biến đổi phi tuyến chồng chéo

Điều này khiến việc giải thích quyết định của AI trở nên cực kỳ khó khăn – một vấn đề trung tâm trong lĩnh vực Explainable AI.

Chúng ta có thể biết:

Đầu vào (input)

Đầu ra (output)

Nhưng phần ở giữa – cách AI đi từ A đến B – lại giống như một “hộp đen”.

- Khi tương quan đánh lừa thực tế

Sự khác biệt giữa tương quan và nhân quả không chỉ là một chi tiết kỹ thuật – nó là một ranh giới mang tính triết học.

Một ví dụ nổi tiếng:

Số người chết đuối và lượng kem bán ra có tương quan cao

Nhưng không có nghĩa là ăn kem gây chết đuối

Nguyên nhân thực sự là:

Cả hai đều tăng vào mùa hè

AI, nếu không được kiểm soát, có thể dễ dàng rơi vào những “cái bẫy” như vậy.

- Hệ quả nguy hiểm trong thế giới thực

Ví dụ “chó và cỏ” có vẻ vô hại. Nhưng hãy mở rộng nó ra:

- Y tế

Một hệ thống AI chẩn đoán bệnh có thể:

Không nhận diện khối u

Mà nhận diện… watermark của máy chụp X-quang từ một bệnh viện cụ thể

- Tuyển dụng

Một mô hình lọc CV có thể:

Không đánh giá năng lực